bp神经网络用法

- 行业动态

- 2025-04-11

- 2

BP神经网络是一种多层前馈神经网络,通过误差反向传播算法训练模型,广泛应用于模式识别、数据预测、分类和回归任务,其具备自主学习能力,通过调整权值阈值优化网络性能,在图像处理、金融预测和工业控制等领域具有较高实用价值,但需注意过拟合及训练效率问题。

在人工智能与机器学习的快速发展中,BP神经网络(误差反向传播神经网络)因其强大的非线性拟合能力和广泛的应用场景,成为算法工程师和科研人员的核心工具之一,以下内容将系统解析BP神经网络的原理、应用场景及实践建议,帮助读者深入理解其技术价值。

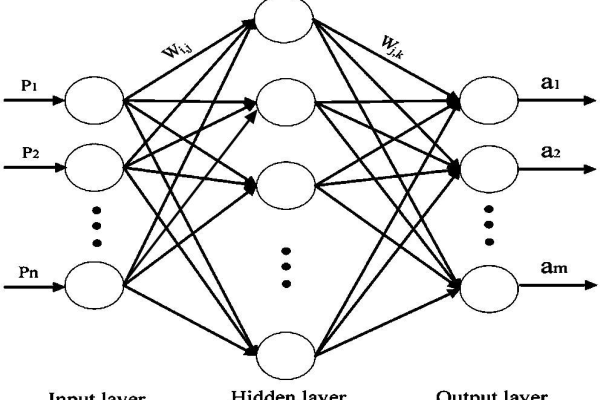

BP神经网络的核心原理

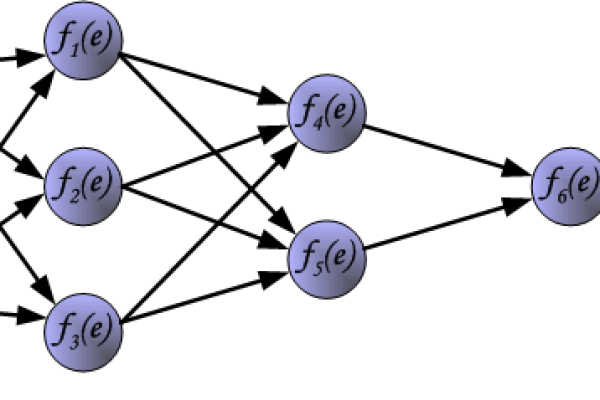

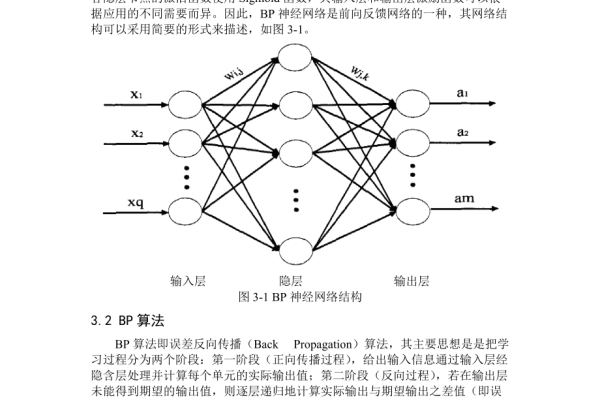

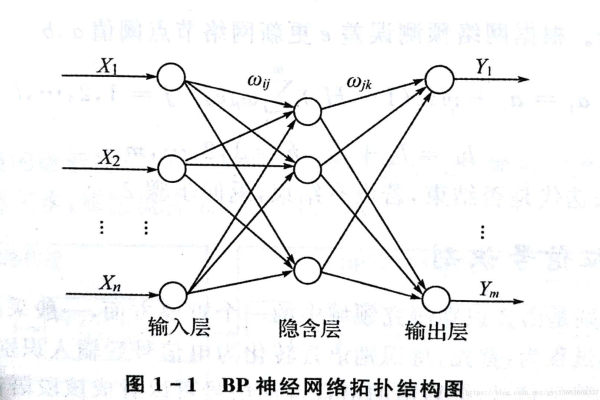

BP神经网络是一种多层前馈神经网络,通过误差反向传播算法(Backpropagation)调整网络权值,以最小化预测值与实际值的误差,其工作流程分为三个关键步骤:

- 前向传播:输入数据从输入层经隐藏层逐层计算,最终输出预测结果。

- 误差计算:通过损失函数(如均方误差MSE)衡量预测误差。

- 反向传播:利用梯度下降法将误差反向传递,逐层调整权重和偏置,优化网络性能。

核心优势在于能够自动学习数据的复杂模式,适用于高维、非线性的问题建模。

BP神经网络的典型应用领域

BP神经网络已在多个场景中实现商业化落地,以下是其典型应用方向:

金融预测与风险管理

- 股票价格预测:通过历史交易数据训练模型,捕捉市场波动规律。

- 信用评分:结合用户特征数据,评估贷款违约风险。

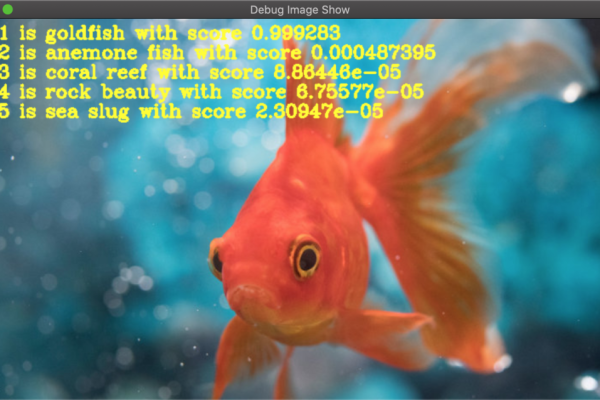

图像识别与计算机视觉

- 手写数字识别:MNIST数据集的经典案例,识别准确率超99%。

- 医学影像分析:辅助诊断肺部结节、视网膜病变等疾病。

自然语言处理(NLP)

- 文本分类:通过词向量输入,实现新闻主题分类或情感分析。

- 语音识别:结合时序数据处理,提升语音转文字的准确率。

实践中的关键技巧与注意事项

要充分发挥BP神经网络的潜力,需重点关注以下技术细节:

数据预处理

- 标准化/归一化:消除量纲影响,加速模型收敛。

- 数据增强:通过旋转、裁剪等方式扩充图像数据集。

网络结构设计

- 隐藏层数量:通常1-3层,过多易导致过拟合。

- 激活函数选择:ReLU(隐藏层)与Sigmoid(输出层)的经典组合。

参数调优策略

- 学习率:初始值建议0.001-0.1,配合动态调整策略。

- 批量大小:常用32-256,需根据硬件配置选择。

正则化技术

- Dropout:随机屏蔽神经元,增强泛化能力。

- L2正则化:约束权重参数,防止过拟合。

常见问题与解决方案

梯度消失/爆炸

解决方案:使用ReLU激活函数、Batch Normalization或残差结构。

过拟合

解决方案:增加训练数据量、采用早停法(Early Stopping)或交叉验证。

训练速度慢

解决方案:采用GPU加速、优化网络结构或使用Adam等自适应优化器。

未来发展趋势

随着深度学习技术的演进,BP神经网络正在与其他先进技术融合:

- 结合强化学习:在机器人控制、游戏AI中提升决策能力。

- 轻量化部署:通过模型剪枝、量化技术适配边缘计算设备。

- 可解释性增强:利用可视化工具分析神经元激活模式,提升模型透明度。

引用说明

本文技术细节参考以下权威资料:

- 周志华《机器学习》(清华大学出版社)

- Ian Goodfellow等《深度学习》(人民邮电出版社)

- 国际期刊《Neural Networks》(Elsevier)

- 开源框架TensorFlow官方文档(Apache 2.0 License)