cdn更新文件后不生效怎么解决

- 行业动态

- 2024-02-17

- 5

更新CDN文件后,如果内容不生效,可尝试清除浏览器缓存或使用强制刷新。

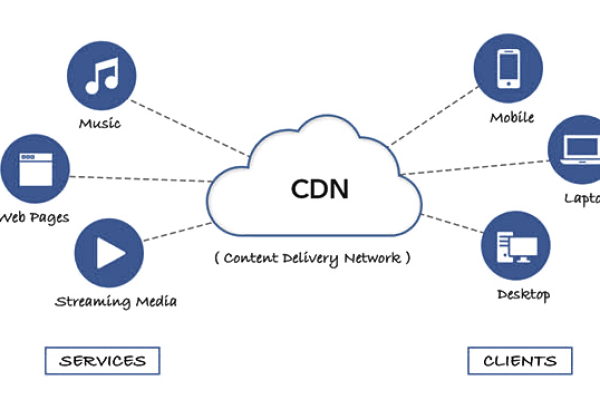

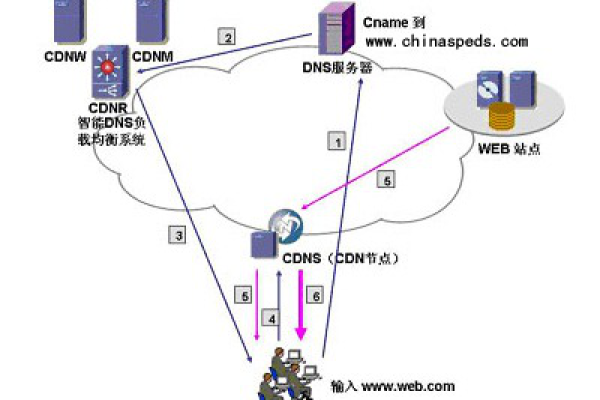

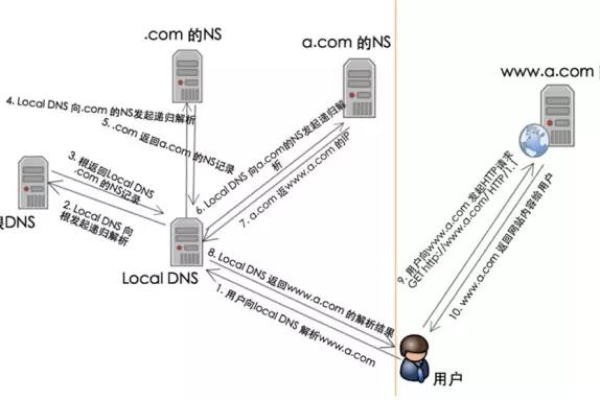

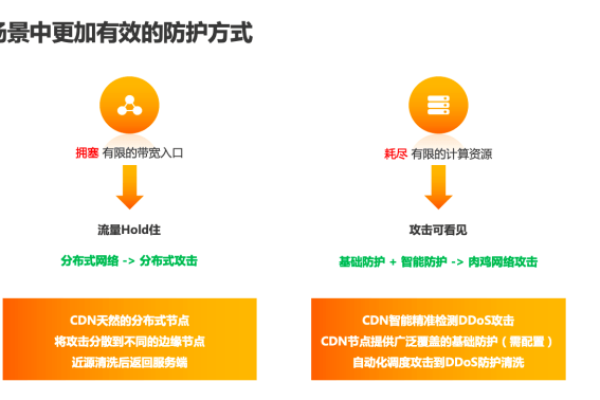

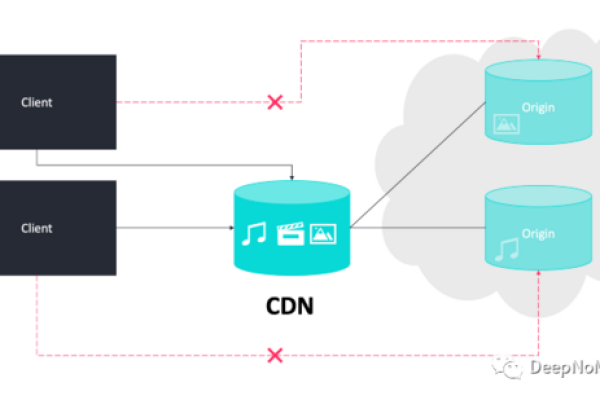

在使用内容分发网络(CDN)服务时,我们可能会遇到更新文件后不生效的问题,这通常是因为CDN节点上的缓存未及时更新导致的,为了解决这个问题,我们可以采取以下几种方法:

1、清除CDN缓存

当我们更新了文件后,可以通过CDN服务商提供的管理后台,手动清除对应的缓存,这样,当用户再次访问该资源时,CDN会从源站重新拉取最新的文件,需要注意的是,不同的CDN服务商可能有不同的操作方式,具体操作请参考服务商的文档。

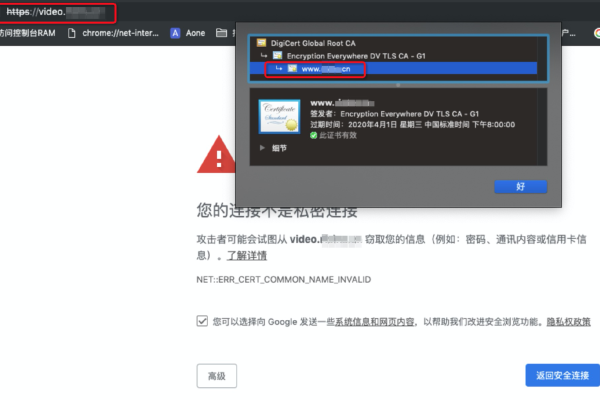

2、使用版本号或者时间戳

为了避免每次更新文件都需要手动清除缓存,我们可以在文件的URL中添加版本号或者时间戳,这样,即使文件内容没有变化,URL也会发生变化,从而触发CDN重新拉取文件,我们可以将CSS文件的URL设置为https://cdn.example.com/style.css?v=1.0.1,当需要更新文件时,只需修改版本号即可。

3、设置缓存过期时间

在配置CDN缓存时,可以设置缓存过期时间,这样,当缓存过期后,CDN会自动从源站拉取最新的文件,需要注意的是,设置过短的过期时间可能会导致CDN频繁地从源站拉取文件,增加源站的压力,建议根据实际需求合理设置缓存过期时间。

4、使用CDN预热功能

部分CDN服务商提供了预热功能,即在文件更新前,提前将新文件推送到CDN节点,这样,当文件更新后,用户可以立即访问到最新的文件,具体的操作方式请参考服务商的文档。

5、检查源站文件是否更新

如果以上方法都无法解决问题,建议检查源站的文件是否已经更新,有可能是源站的文件未更新导致的问题,还需要检查CDN的配置是否正确,确保CDN能够正确地拉取到源站的文件。

相关问题与解答:

1、为什么更新文件后CDN仍然显示旧的文件?

答:可能是因为CDN节点上的缓存未及时更新导致的,可以尝试清除CDN缓存或者使用版本号、时间戳等方式解决。

2、如何避免每次更新文件都需要手动清除CDN缓存?

答:可以使用版本号或者时间戳的方式,让文件的URL在每次更新时都发生变化,从而触发CDN重新拉取文件。

3、设置缓存过期时间会不会增加源站的压力?

答:设置过短的缓存过期时间可能会导致CDN频繁地从源站拉取文件,增加源站的压力,建议根据实际需求合理设置缓存过期时间。

4、什么是CDN预热功能,如何使用?

答:CDN预热功能是指在文件更新前,提前将新文件推送到CDN节点,具体的操作方式请参考服务商的文档。