高速免备案云主机

- 行业动态

- 2024-01-21

- 5

在当今的互联网时代,云主机已经成为了企业和个人用户的首选,它不仅提供了强大的计算能力,还具有高度的灵活性和可扩展性,对于一些高速应用来说,传统的云主机可能无法满足其需求,因为它们需要更高的网络速度和更低的延迟,为了解决这个问题,高速免备案云主机应运而生。

什么是高速免备案云主机?

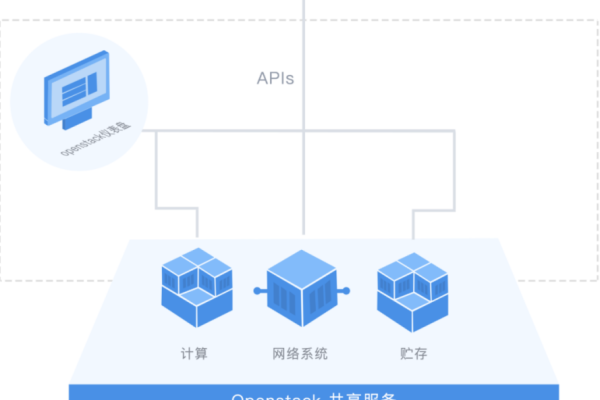

高速免备案云主机是一种专门为高速应用设计的云主机,它具有更高的网络速度和更低的延迟,这种云主机通常使用专用的网络连接,可以直接连接到互联网骨干网,从而大大提高了网络速度,由于这种云主机不需要进行备案,因此用户可以立即开始使用,无需等待备案过程。

高速免备案云主机的技术特点

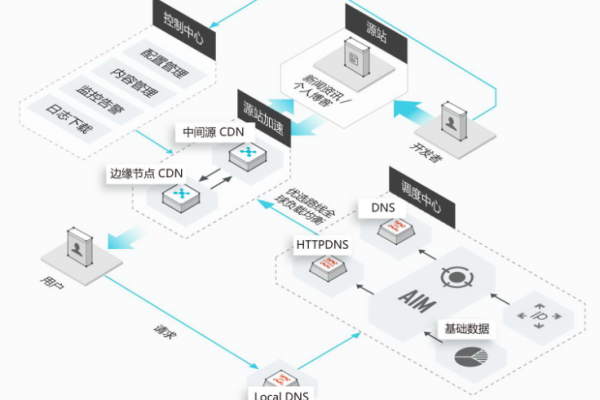

1、高速网络:高速免备案云主机通常使用专用的网络连接,可以直接连接到互联网骨干网,从而大大提高了网络速度,这种网络连接通常具有更高的带宽和更低的延迟,可以满足高速应用的需求。

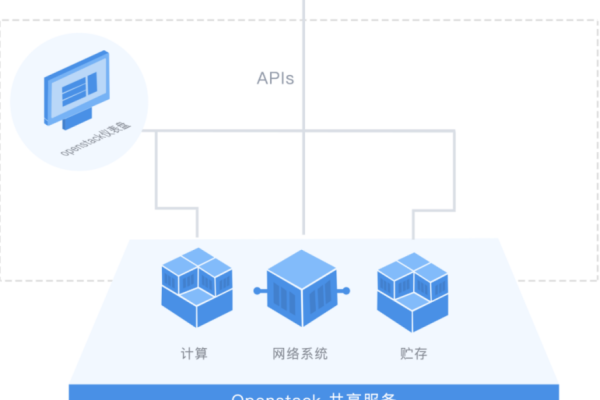

2、高性能硬件:高速免备案云主机通常配备高性能的硬件设备,包括高速的CPU、大容量的内存和高速的硬盘,这些硬件设备可以提供强大的计算能力,满足高速应用的需求。

3、灵活的扩展性:高速免备案云主机可以根据用户的需求进行灵活的扩展,用户可以根据业务的发展情况,随时增加或减少云主机的数量,以满足业务的需求。

4、高可用性:高速免备案云主机通常具有高可用性,如果一台云主机出现故障,系统会自动将用户的业务迁移到其他云主机上,从而保证业务的连续性。

高速免备案云主机的应用场景

1、视频流媒体:对于视频流媒体应用来说,网络速度和延迟是非常重要的,高速免备案云主机可以提供足够的网络速度和低延迟,满足视频流媒体的需求。

2、在线游戏:在线游戏需要高网络速度和低延迟,以确保玩家的游戏体验,高速免备案云主机可以提供这样的网络环境,满足在线游戏的需求。

3、大数据分析:大数据分析需要大量的计算能力,而高速免备案云主机可以提供强大的计算能力,满足大数据分析的需求。

4、云计算:云计算需要高网络速度和低延迟,以确保数据的快速传输,高速免备案云主机可以提供这样的网络环境,满足云计算的需求。

相关问题与解答

1、高速免备案云主机的价格如何?

答:高速免备案云主机的价格通常会比普通的云主机更高,因为它提供了更高的网络速度和更低的延迟,具体的价格需要根据供应商的定价策略来确定。

2、高速免备案云主机的稳定性如何?

答:高速免备案云主机通常具有高稳定性,由于它使用了专用的网络连接和高性能的硬件设备,因此可以提供稳定的服务。

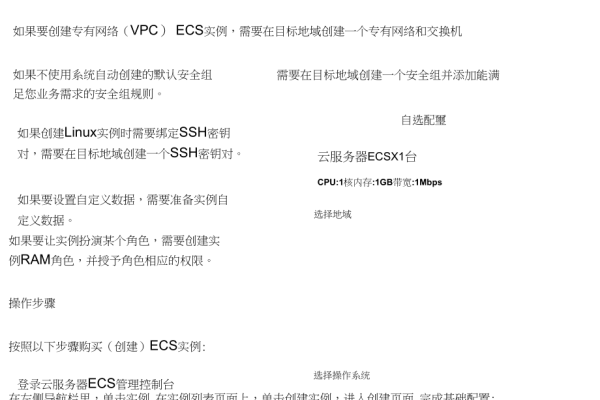

3、我可以自己选择高速免备案云主机的配置吗?

答:是的,你可以根据自己的需求选择高速免备案云主机的配置,大多数供应商都提供了多种配置供用户选择。

4、如果我需要更多的云主机,我可以随时增加吗?

答:是的,如果你的业务发展需要更多的云主机,你可以随时增加,大多数供应商都提供了灵活的扩展性,你可以根据自己的需求随时增加或减少云主机的数量。