独立ip虚拟主机有哪些优势,独立ip虚拟主机的原理与应用

- 行业动态

- 2024-03-05

- 11

独立IP虚拟主机提供独特IP地址,增强安全性,减少共享资源影响,有利于SEO优化,适合需要独立资源和高安全性的网站应用。

独立IP虚拟主机,即在一台服务器上为每个网站分配独立的IP地址,与传统的共享IP虚拟主机相比,独立IP虚拟主机具有一些明显优势,同时其工作原理与应用也具有一定的特殊性,以下是关于独立IP虚拟主机的优势、原理及应用的详细介绍。

优势

1、提高安全性:独立IP虚拟主机能够有效降低因服务器上其他网站遭受攻击而影响到自己网站的风险,从而提高网站的安全性。

2、增强搜索引擎优化(SEO)表现:拥有独立IP的网站在搜索引擎排名中通常会有一定的优势,因为搜索引擎会认为这些网站更加专业和可靠。

3、避免IP被封风险:如果服务器上的某个网站涉及到违规内容被封锁IP,那么共享该IP的其他网站也会受到影响,使用独立IP可以规避这种风险。

4、提升用户信任度:独立IP地址通常被看作是网站专业性的标志,有利于树立用户对网站的信任感。

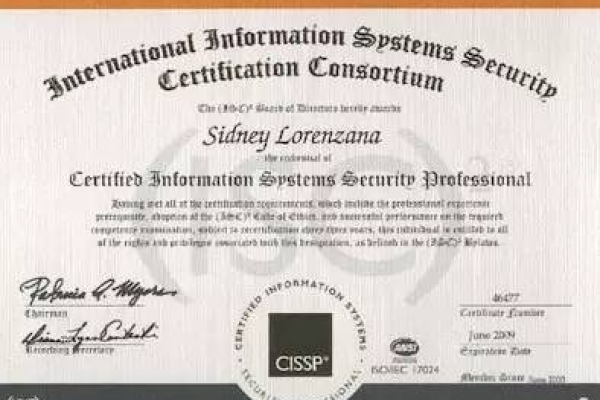

5、SSL证书安装:使用独立IP可以更方便地为网站安装SSL证书,实现网站的HTTPS加密访问,保障数据传输安全。

原理

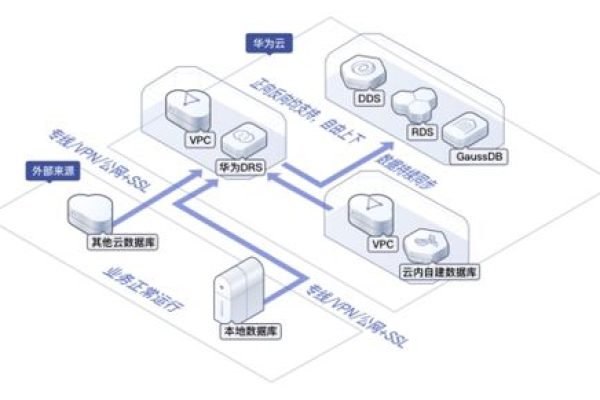

独立IP虚拟主机的原理主要基于网络的IP地址分配和管理机制,在服务器上,每个虚拟主机可以被分配一个独立的公网IP地址,这样每个网站就能够通过不同的IP地址进行访问,服务器的软件配置会确保来自特定IP地址的请求被正确地路由到相应的虚拟主机目录中。

从技术层面上来说,服务器的网络接口卡(NIC)配置了多个IP地址,每个虚拟主机绑定一个,当用户的请求到达服务器时,服务器会根据来源IP地址决定将请求转发给哪个虚拟主机处理。

应用

独立IP虚拟主机的应用非常广泛,尤其适用于以下场景:

1、电子商务网站:为了保护交易安全和用户数据,电商网站通常需要使用独立IP地址。

2、金融机构网站:银行、保险公司等金融机构的网站对安全性要求极高,因此常常采用独立IP以增加安全性。

3、企业官方网站:为了体现企业形象和提升用户信任度,许多企业会选择独立IP虚拟主机服务。

4、高流量网站:访问量较大的网站往往需要更好的性能和稳定性,独立IP可以提供更加可靠的服务。

5、多域名托管:对于需要管理多个域名的用户,使用独立IP虚拟主机可以方便地对各个网站进行隔离和管理。

相关问题与解答

Q1: 独立IP虚拟主机是否比共享IP虚拟主机更贵?

A1: 是的,由于独立IP提供了额外的安全性和专业性,其成本通常高于共享IP虚拟主机。

Q2: 独立IP虚拟主机是否适合个人博客或小型网站?

A2: 对于个人博客或小型网站而言,如果预算允许且对安全性和专业性有较高要求,可以选择独立IP虚拟主机,否则,共享IP虚拟主机可能已经足够使用。

Q3: 独立IP虚拟主机能否提升网站的加载速度?

A3: 独立IP本身并不直接影响网站的加载速度,但使用独立IP的虚拟主机可能会有更好的服务器资源分配,间接地提升了网站的响应速度。

Q4: 如何选择合适的独立IP虚拟主机提供商?

A4: 在选择独立IP虚拟主机提供商时,应考虑提供商的信誉、服务质量、客户支持、价格以及提供的额外功能等因素,以确保选择到性价比高的服务。