如何免费下载网站模板,提供高质量低成本的网站建设

- 行业动态

- 2024-02-05

- 3

提供步骤指南免费下载网站模板,实现高质量且低成本的网站建设方法。

在数字化时代,拥有一个专业的网站对于企业或个人品牌来说至关重要,幸运的是,即使预算有限,也可以通过下载免费的网站模板来构建一个高质量的网站,以下是如何免费下载网站模板以及提供高质量且低成本的网站建设的详细步骤和技术介绍。

寻找免费网站模板资源

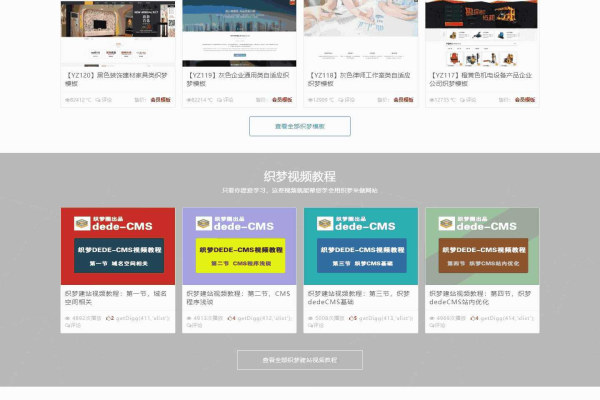

网络上有许多平台和资源可以提供免费的网站模板下载,一些流行的平台如WordPress、Joomla和Drupal等都拥有大量的免费主题和模板,这些模板通常由专业设计师制作,并允许用户根据个人需求进行定制。

1、WordPress:作为最受欢迎的内容管理系统(CMS),WordPress提供了数以千计的免费主题,用户可以直接从WordPress的主题目录中选择并安装。

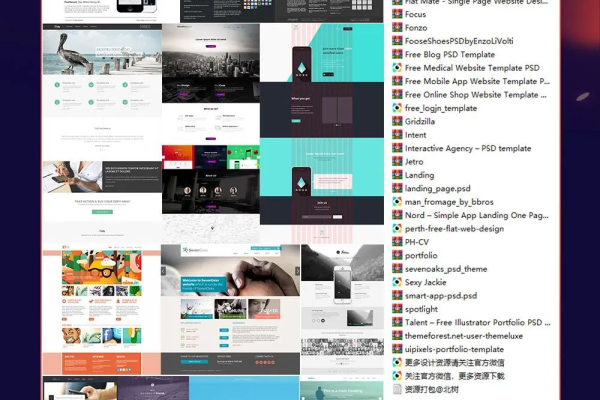

2、GitHub:开发者和设计师经常在GitHub上分享他们的模板项目,通过搜索相关关键词,可以找到许多免费可用的HTML/CSS模板。

3、TemplateMonster:尽管这个平台上的一些模板是付费的,但它们也提供了免费的网站模板选项。

4、FreeTemplate.co:此网站专门提供免费的HTML5、CSS3和响应式网站模板。

选择合适的模板

在选择免费模板时,需要考虑以下几个因素:

响应式设计:确保模板能够适应不同设备和屏幕尺寸。

兼容性:检查模板是否兼容主要的浏览器。

定制性:选择一个易于定制的模板,以便根据自己的需求进行调整。

功能性:考虑模板是否包含所需的功能,如联系表单、社交媒体集成等。

下载与安装

找到合适的模板后,下载文件并按照以下步骤进行安装:

1、解压文件:如果模板是压缩文件,需要先解压。

2、上传文件:通过FTP客户端或网站托管服务的控制面板上传模板文件到服务器。

3、安装模板:根据所选CMS的指南进行模板的安装和激活。

定制网站

一旦模板安装完成,就可以开始定制网站了:

添加内容:将文本、图片和视频等媒体内容添加到网站中。

调整布局:根据需要调整页面布局和模块位置。

修改颜色和字体:更改网站的配色方案和字体以符合品牌形象。

插件和扩展:如果需要额外的功能,可以安装适合的插件或扩展。

优化和测试

在网站上线前,进行以下优化和测试工作:

SEO优化:优化网站的搜索引擎排名,包括元标签、标题和描述等。

速度优化:通过压缩图片和使用缓存插件来提高网站的加载速度。

跨浏览器测试:确保网站在所有主流浏览器上都能正常工作。

用户体验测试:获取用户的反馈,并根据反馈调整网站以提高用户体验。

相关问题与解答

Q1: 使用免费网站模板有哪些风险?

A1: 免费模板可能存在安全风险,因为它们可能未经充分审核,免费模板的使用条款可能限制商业使用或要求保留版权信息。

Q2: 我可以在商业网站上使用免费模板吗?

A2: 可以,但必须确保模板的使用许可允许商业用途,并且你已经遵守了所有的使用条款和条件。

Q3: 如何确保免费模板的质量?

A3: 可以从信誉良好的来源下载模板,查看其他用户的评价和反馈,以及亲自测试模板的功能和响应性。

Q4: 如果我想要更定制化的网站,应该怎么办?

A4: 如果免费模板不能满足你的需求,可以考虑聘请专业的网页设计师进行定制开发,或者学习相关的网页设计和开发技能自行开发。