安全模式下的网络连通性问题,为何无法建立网络连接?

- 行业动态

- 2025-03-04

- 5

安全模式下没有网络连接的详细解答

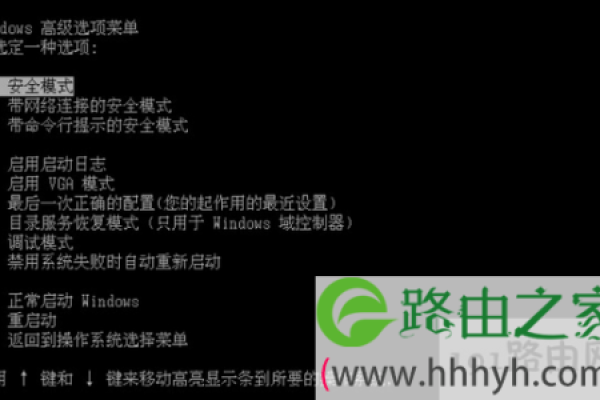

一、什么是安全模式?

安全模式是操作系统的一种特殊启动方式,它允许用户在最低限度的系统资源和驱动程序加载情况下运行计算机,这种模式主要用于诊断和解决系统问题,如干扰清除、驱动冲突、系统错误等,在安全模式下,系统会加载最基本的驱动程序和服务,以确保计算机能够稳定运行。

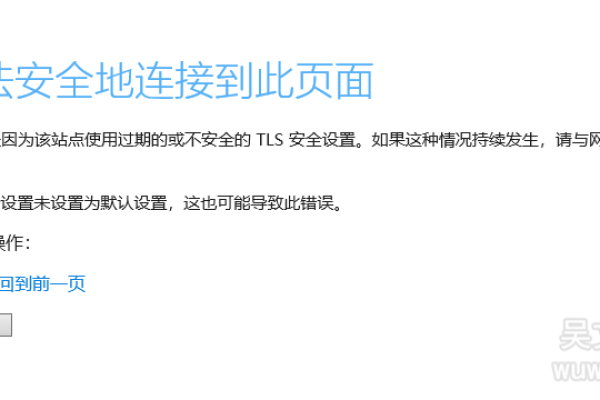

二、为什么安全模式下没有网络连接?

在安全模式下,由于系统只加载了最基本的驱动程序和服务,因此默认情况下可能不会加载网络适配器的驱动程序或相关服务,从而导致无法连接网络,即使网络适配器的驱动程序被加载,如果相关的网络服务(如DHCP客户端、DNS解析服务等)没有被启动,也会导致网络连接失败。

三、如何恢复安全模式下的网络连接?

要恢复安全模式下的网络连接,可以尝试以下几种方法:

1、手动加载网络驱动程序:

在Windows系统中,可以通过设备管理器找到网络适配器,右键选择“更新驱动程序”,然后选择“浏览计算机以查找驱动程序软件”,并手动指定驱动程序的位置。

在Linux系统中,可以使用命令行工具如lspci或lsusb来识别网络适配器,并使用相应的命令来加载驱动程序。

2、启用必要的网络服务:

在Windows系统中,可以按Win+R键打开“运行”对话框,输入services.msc并回车,找到“Network Location Awareness”、“DHCP Client”、“DNS Client”等服务,确保它们已启动,并将启动类型设置为“自动”。

在Linux系统中,可以使用命令行工具如systemctl来启用和启动网络服务,例如sudo systemctl start NetworkManager。

3、检查网络配置:

确保网络适配器的IP地址、子网掩码、网关和DNS服务器设置正确。

在Windows系统中,可以通过“控制面板”->“网络和共享中心”->“更改适配器设置”来查看和修改网络配置。

在Linux系统中,可以编辑/etc/network/interfaces(对于Debian/Ubuntu系统)或/etc/sysconfig/network-scripts/ifcfg-<接口名>(对于CentOS/RHEL系统)来配置网络。

4、重启网络服务或计算机:

在Windows系统中,可以右键点击任务栏中的网络图标,选择“打开网络和Internet设置”,然后点击“更改适配器选项”,右键点击网络适配器并选择“禁用”,然后再右键点击并选择“启用”。

在Linux系统中,可以使用sudo systemctl restart NetworkManager命令来重启网络服务。

四、示例表格:常见网络服务及其作用

| 服务名称 | 描述 | 是否必需(安全模式下) |

| Network Location Awareness | 检测网络位置变化并通知应用程序 | 否 |

| DHCP Client | 动态获取IP地址 | 是(如果需要动态分配IP) |

| DNS Client | 将域名解析为IP地址 | 是(如果需要访问域名) |

五、FAQs

Q1: 安全模式下能否连接无线网络?

A1: 是的,安全模式下可以连接无线网络,但前提是必须手动加载无线网卡的驱动程序,并确保无线网络服务(如WLAN AutoConfig)已启动且配置正确。

Q2: 安全模式下是否需要手动配置IP地址才能上网?

A2: 这取决于具体情况,如果网络环境需要动态分配IP地址(如通过DHCP),则必须确保DHCP客户端服务已启动,如果网络环境是静态IP地址分配,则需要手动配置IP地址、子网掩码、网关和DNS服务器等信息,在大多数情况下,建议先尝试让系统自动获取IP地址(即启用DHCP),如果失败再考虑手动配置。