开发软件中的AOP服务器权限究竟意味着什么?

- 行业动态

- 2024-10-03

- 8

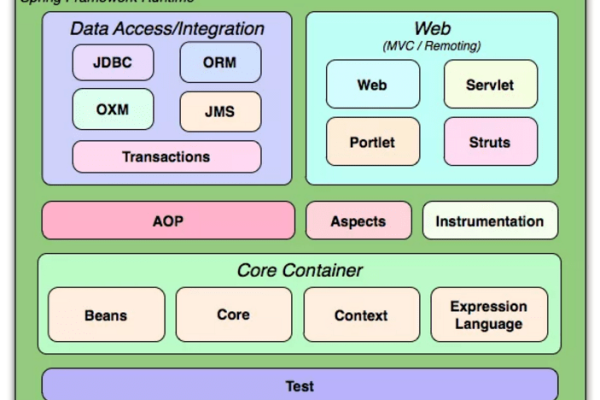

AOP(AspectOriented Programming,面向切面编程)是一种编程范式,它允许开发人员将系统中的横切关注点(如日志记录、权限控制等)从核心业务逻辑中分离出来,在软件开发过程中,通过使用AOP技术,可以更有效地管理和控制服务器权限。

什么是AOP?

1、定义:

AOP是一种编程范式,用于将应用程序中的横切关注点(例如日志记录、安全性和事务管理)与业务逻辑代码相分离。

通过预编译方式和运行期间动态代理实现程序功能的统一维护。

2、主要功能:

日志记录:自动记录系统操作日志,无需在每个方法中手动添加日志代码。

性能监控:实时监控系统性能,发现并解决性能瓶颈。

安全检查:在方法执行前后进行权限校验,确保只有合法用户才能执行特定操作。

AOP在服务器权限管理中的应用

1、解耦代码:

通过AOP,可以将与业务逻辑无关的权限管理代码从业务逻辑中解耦出来,使代码更加简洁、可读性更高。

2、重用功能:

AOP可以将一些通用的权限管理功能抽象出来,在多个模块中进行重用,提高代码的复用性。

3、横向关注点:

AOP专注于横向关注点的开发,而不需要深入到每个业务逻辑中,提高开发效率。

AOP权限管理的实现步骤

1、确定关注点:

首先需要确定要在服务器端应用程序中切面化的关注点,例如权限验证。

2、创建切面:

根据已确定的关注点,创建相应的切面,切面是一种包含与关注点相关逻辑的模块。

3、定义切点:

切点是在应用程序中指定连接点的位置的抽象概念,它描述了应该在何处将切面逻辑插入到应用程序中。

4、创建通知:

通知是与切点关联的切面逻辑,它定义了在什么时候和如何将逻辑应用于切点。

5、组装切面:

将切面、切点和通知结合在一起,以创建一个综合的切面。

6、部署切面:

将切面部署到服务器端应用程序中,这可能涉及到在应用程序中集成AOP框架或容器。

7、测试和调试:

在服务器端应用程序中进行测试和调试,确保切面逻辑按预期工作,并且关注点得到正确处理。

8、部署和运行:

将经过AOP切面处理的服务器端应用程序部署到目标服务器,并启动运行。

AOP在服务器权限管理中提供了一种灵活、模块化、可维护的开发方式,帮助开发者更好地处理与业务无关的横切关注点,通过AOP的使用,开发者可以更加专注于业务逻辑的编写,提高代码的可读性和可维护性。

【开发软件AOP服务器权限详解】

一、AOP简介

AOP(AspectOriented Programming,面向切面编程)是一种编程范式,它允许开发者将横切关注点(Crosscutting Concerns)从业务逻辑中分离出来,从而提高代码的模块化和复用性,在软件开发中,横切关注点通常指的是那些在多个模块中重复出现的功能,如日志记录、事务管理、安全控制等。

二、服务器权限

服务器权限是指对服务器资源(如文件、数据库、网络等)的访问权限控制,它确保只有授权的用户或系统能够访问特定的资源,防止未授权的访问和数据泄露。

三、AOP与服务器权限的结合

在开发软件中,AOP服务器权限指的是使用AOP技术来实现对服务器资源的权限控制,它包含以下几个方面:

1、权限检查:在执行服务器操作之前,通过AOP技术拦截请求,检查用户是否有权限执行该操作。

2、权限管理:通过AOP实现权限的动态分配和修改,例如根据用户角色或权限等级来控制访问。

3、日志记录:使用AOP记录用户访问服务器资源的行为,便于追踪和审计。

4、异常处理:当用户无权限访问资源时,AOP可以捕获异常并给出相应的处理,如返回错误信息或重定向到登录页面。

四、实现方式

以下是使用AOP实现服务器权限控制的一种常见方式:

定义切面(Aspect):创建一个切面类,其中包含权限检查的逻辑。

定义连接点(Pointcut):指定哪些方法或类需要进行权限检查。

定义通知(Advice):定义在连接点执行的具体操作,如权限检查。

织入(Weaving):将切面织入到目标类中,使得每次调用目标方法时都会执行切面中的逻辑。

通过以上方式,AOP服务器权限可以帮助开发者更有效地管理和服务器的访问权限,提高系统的安全性。