如何有效地查询MySQL数据库中的数据总量及错误日志?

- 行业动态

- 2024-10-08

- 10

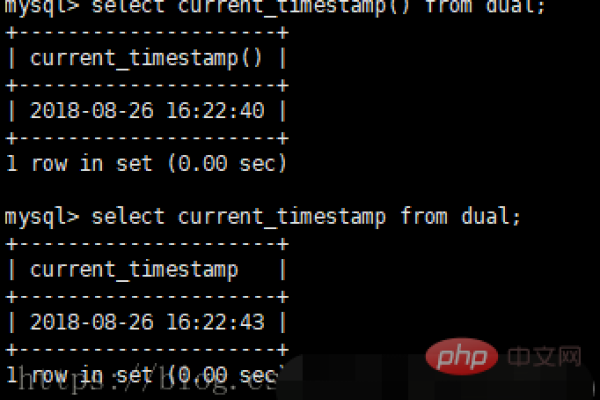

要查询MySQL数据库数据总量和错误日志,可以使用以下SQL语句:,,1. 查询数据库

数据总量:,“

sql,SELECT table_schema AS 'Database', SUM(data_length + index_length) / 1024 / 1024 AS 'Size (MB)' FROM information_schema.tables GROUP BY table_schema;,`

,,2. 查询错误日志:,`

sql,SHOW VARIABLES LIKE 'log_error';,“

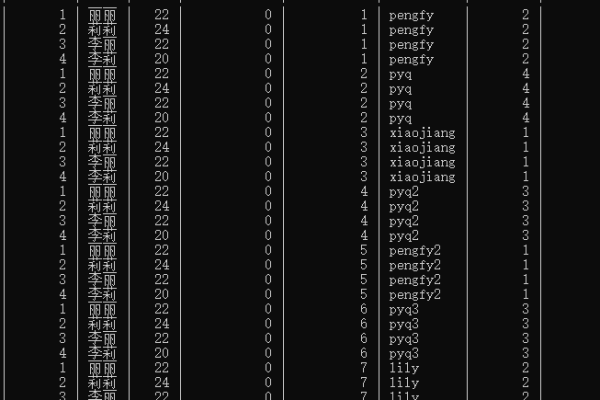

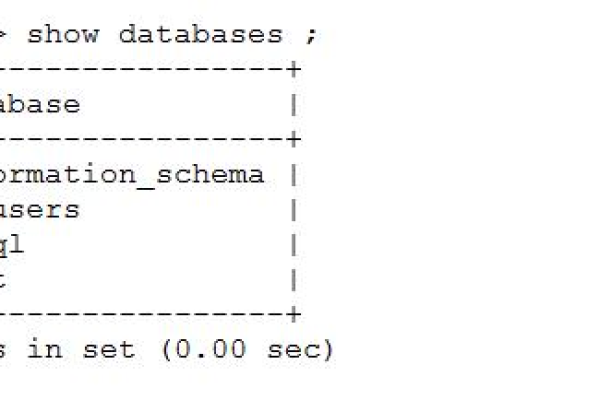

要查询MySQL数据库中的数据总量,可以使用以下SQL语句:

SELECT table_schema AS 'Database', SUM(data_length + index_length) / 1024 / 1024 AS 'Size (MB)' FROM information_schema.TABLES GROUP BY table_schema;

这个查询将返回每个数据库的名称和大小(以MB为单位),如果你想查看特定数据库的大小,可以在WHERE子句中指定数据库名称。

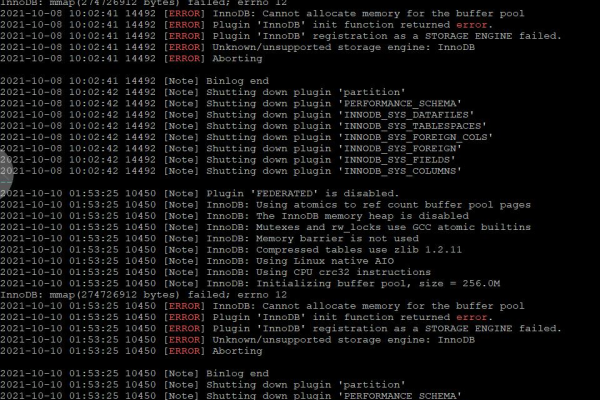

查询数据库错误日志:

MySQL的错误日志通常位于服务器的文件系统中,具体位置取决于你的MySQL安装和配置,以下是一些常见的错误日志文件路径:

/var/log/mysql/error.log

/var/log/mysqld.log

/usr/local/mysql/data/hostname.err

C:ProgramDataMySQLMySQL Server 8.0Datahostname.err

你可以使用文本编辑器或命令行工具查看这些文件的内容,在Linux系统上,你可以使用tail命令查看最近的日志条目:

tail n 50 /var/log/mysql/error.log

这将显示错误日志文件的最后50行,如果你需要更详细的信息,可以增加n参数的值。

下面是一个归纳,其中包含了两个查询语句:一个用于查询数据库的数据总量,另一个用于查询MySQL的错误日志。

| 查询目的 | SQL查询语句 |

| 查询数据库数据总量 | “SELECT SUM(data_length + index_length) AS total_data_size FROM information_schema.TABLES WHERE table_schema = 'your_database_name';“ |

| 查询MySQL错误日志 | “SHOW VARIABLES LIKE 'log_error';“ |

说明:

1、第一个查询用于获取指定数据库的数据总量,其中your_database_name需要替换为你的数据库名称。

2、第二个查询用于查看MySQL的错误日志的配置信息,通常错误日志配置在MySQL的配置文件中(如my.cnf或my.ini),该查询会返回错误日志的路径。

第二个查询只是查看配置信息,如果你需要查看具体的错误日志内容,你需要直接访问错误日志文件,路径通常由log_error变量的值指定。