服务器实现负载均衡

- 行业动态

- 2025-02-01

- 1

服务器实现负载均衡的方法包括硬件负载均衡器、软件负载均衡器、DNS 负载均衡等,可提升性能与可靠性。

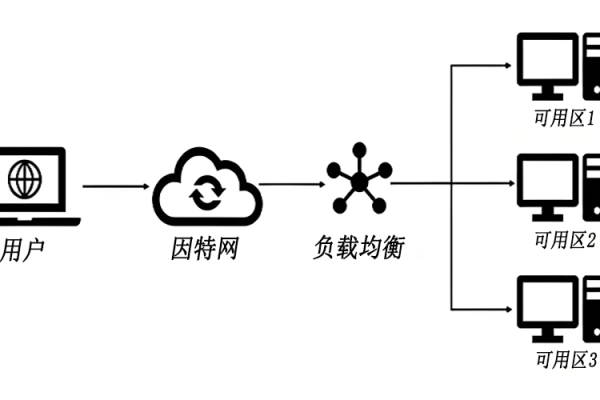

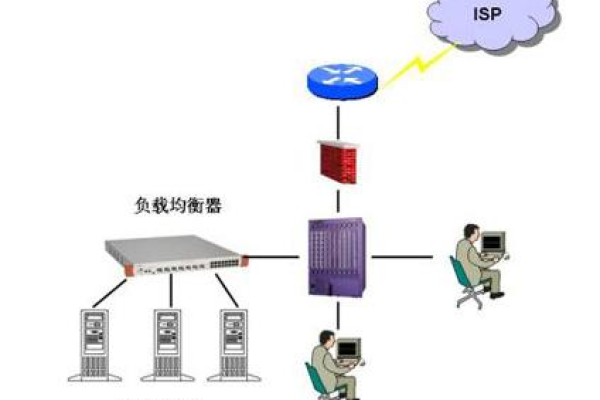

服务器实现负载均衡是确保系统高效、稳定运行的关键技术,在现代网络环境中,随着用户数量的增加和业务需求的多样化,单一服务器往往难以承受巨大的访问压力,通过负载均衡技术将请求分散到多个服务器上,可以有效提高系统的处理能力和可靠性,下面将从负载均衡的概念、常见算法、实现方式以及实际应用案例几个方面进行详细阐述。

一、负载均衡的基本概念

负载均衡(Load Balancing)指的是将网络或应用程序的访问请求均匀地分配到多台服务器上,以避免单点过载,提高整体系统的响应速度和可用性,它主要通过硬件设备或软件程序来实现,根据不同的策略对流量进行智能调度。

二、常见的负载均衡算法

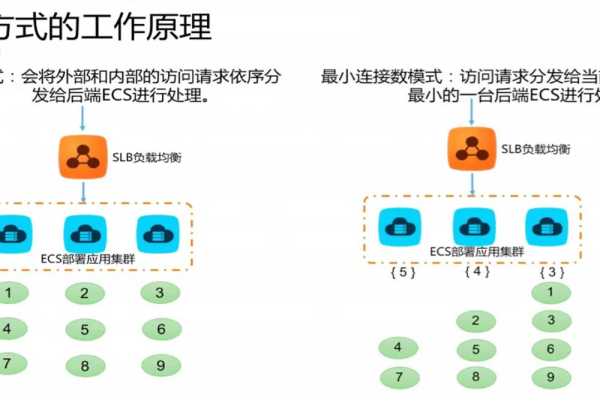

1、轮询法(Round Robin):按照顺序依次将请求分配给每台服务器,简单易行,但不考虑服务器的实际负载情况。

2、加权轮询法(Weighted Round Robin):为每台服务器设定一个权重值,根据权重比例分配请求,适用于服务器性能不均的情况。

3、最少连接法(Least Connections):优先将请求分配给当前连接数最少的服务器,适合会话保持类应用。

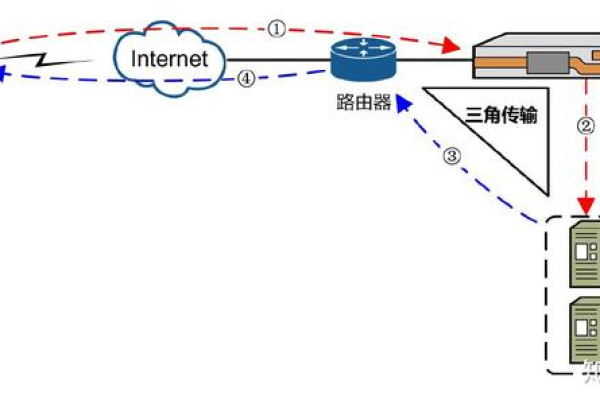

4、源地址哈希法(Source IP Hash):根据客户端IP地址进行哈希运算,确定请求分配的目标服务器,保证同一用户的请求总是由同一台服务器处理。

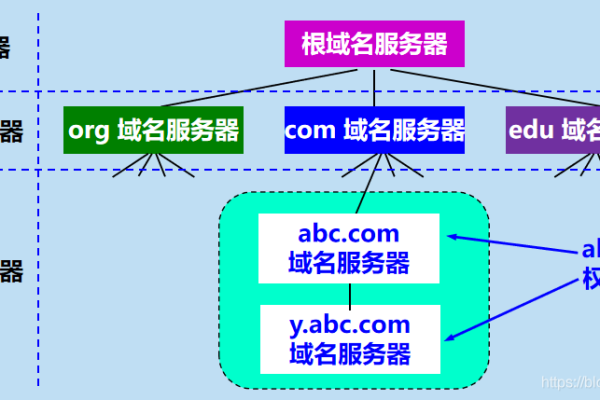

5、URL哈希法(URL Hash):基于请求的URL进行哈希计算,决定请求的转发路径,适用于内容分发网络(CDN)。

三、负载均衡的实现方式

1、硬件负载均衡器:如F5 Big-IP等专业设备,提供高性能的流量管理和负载均衡功能,但成本较高。

2、软件负载均衡器:如Nginx、HAProxy等开源软件,配置灵活,成本较低,广泛应用于中小型企业。

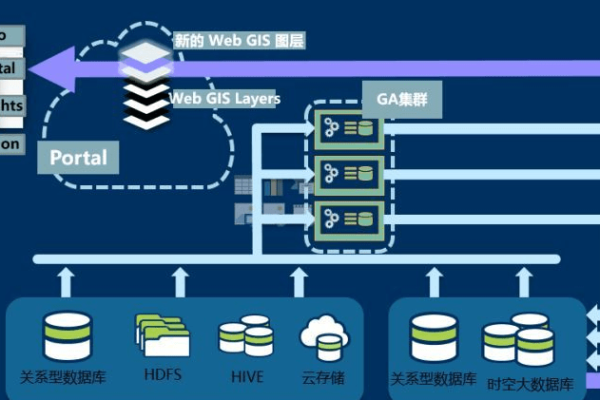

3、云服务提供商的负载均衡服务:如AWS ELB、Azure Load Balancer等,提供高可用性和弹性扩展能力,适合大规模分布式系统。

四、实际应用案例分析

以电商平台为例,假设该平台每天有数百万用户访问,高峰期每秒可能有数千个订单产生,为了保证用户体验和系统稳定性,可以采用以下负载均衡策略:

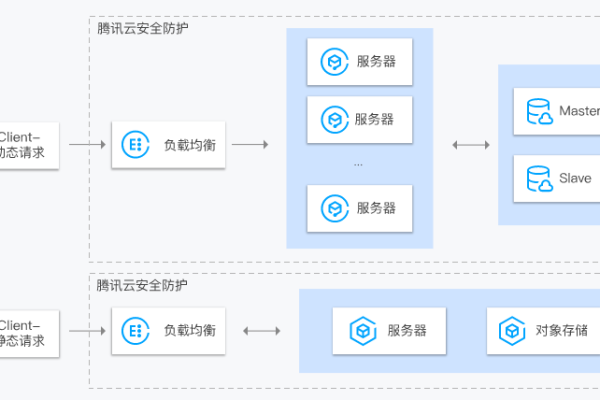

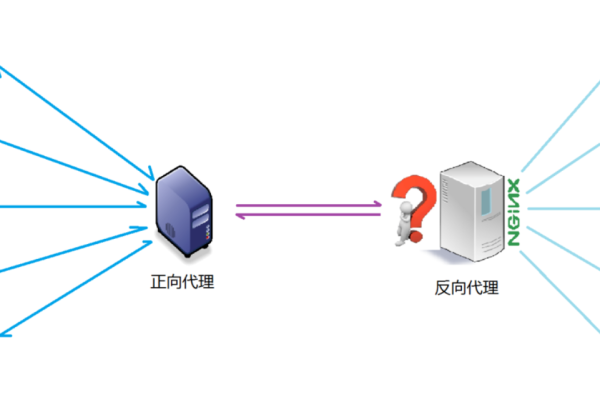

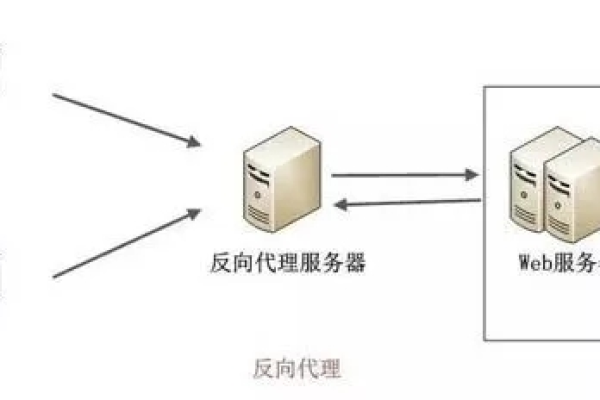

1、前端负载均衡:使用Nginx作为反向代理服务器,根据最少连接数算法将用户请求分发到后端的应用服务器群。

2、数据库读写分离:对于数据库操作,采用主从复制架构,并通过中间件实现读写分离,减轻主库压力。

3、缓存机制:引入Redis或Memcached等缓存系统,减少数据库查询次数,提升响应速度。

4、CDN加速:利用全球分布的内容分发网络,将静态资源缓存至离用户最近的节点,加快页面加载速度。

五、相关问答FAQs

Q1: 负载均衡是否会影响数据一致性?

A1: 负载均衡本身不会直接影响数据一致性,关键在于如何设计数据存储和同步机制,在数据库层面可以通过主从复制、分布式事务等方式保证数据的一致性。

Q2: 如何选择适合自己业务的负载均衡方案?

A2: 选择负载均衡方案时需考虑业务特点、预算限制、技术栈兼容性等因素,建议先评估现有系统瓶颈,再结合不同负载均衡技术的特点做出决策,也可以参考行业内的成功案例和最佳实践。

小编有话说

负载均衡不仅是技术层面的挑战,更是对运维团队综合能力的考验,随着云计算和微服务架构的发展,未来的负载均衡解决方案将更加智能化、自动化,希望本文能为您提供一些有价值的参考信息,帮助您更好地理解和实施服务器负载均衡技术。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:https://www.xixizhuji.com/fuzhu/403656.html