如何高效利用GPU云服务器加速运算?

- 行业动态

- 2025-04-23

- 2

GPU云服务器通过云计算平台租用配备显卡的虚拟主机,适用于AI训练、图形渲染等高性能计算,用户注册账号后选择配置,远程连接部署环境并运行任务,按需付费,需配置安全组、存储及网络,支持灵活扩展资源。

GPU云运算服务器使用指南

在人工智能、科学计算、图形渲染等领域,GPU(图形处理器)凭借其强大的并行计算能力,已成为处理复杂任务的核心工具,而GPU云服务器作为一种按需租用的云计算服务,为用户提供了灵活、高效且低成本的算力解决方案,本文将详细讲解GPU云服务器的使用方法,帮助您快速上手。

什么是GPU云服务器?

GPU云服务器是基于云平台提供的虚拟化服务,搭载高性能GPU显卡(如NVIDIA A100、V100、RTX系列等),结合CPU、内存、存储等资源,可通过网络远程访问和操作,用户无需购买实体硬件,按需付费即可运行深度学习训练、3D渲染、大数据分析等高算力任务。

GPU云服务器的适用场景

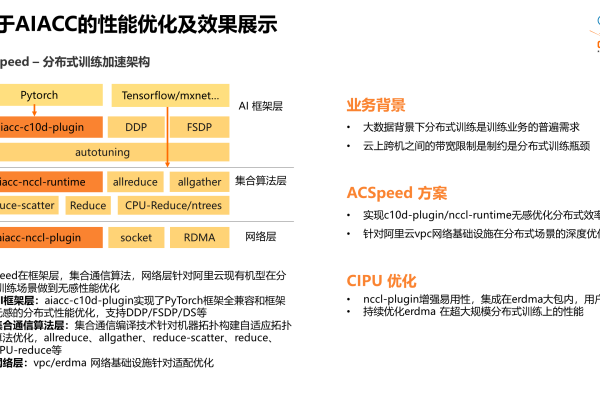

- AI模型训练

支持TensorFlow、PyTorch等框架的分布式训练,加速图像识别、自然语言处理(NLP)等任务。

- 科学计算与仿真

用于气象预测、基因测序、流体力学模拟等需要大量浮点运算的场景。

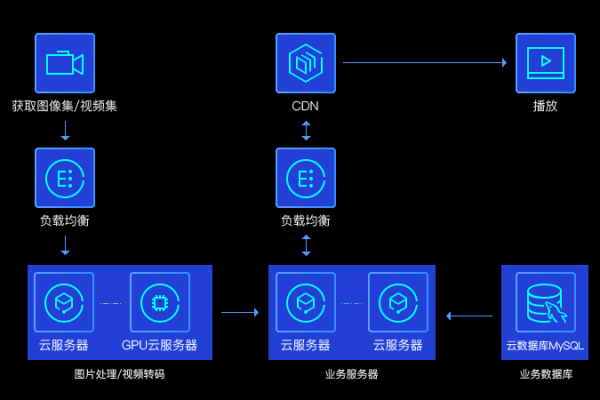

- 图形渲染与视频处理

适用于影视特效渲染、3D建模、实时视频转码等。

- 区块链与密码学

提升哈希计算、加密解密等任务的效率。

GPU云服务器的使用步骤

选择云服务提供商

主流平台包括阿里云、酷盾、AWS、华为云等,根据需求选择配置:

- GPU型号:针对任务类型选择(NVIDIA A100适合高性能计算,RTX 3090适合渲染)。

- 显存容量:显存越大,可处理的数据量越大(如24GB显存支持更复杂的模型)。

- 配套资源:根据任务需求匹配CPU核数、内存、存储空间及带宽。

购买与配置实例

- 创建实例:登录云平台控制台,选择GPU实例类型(如NVIDIA GPU加速实例),按向导完成配置。

- 镜像选择:预装操作系统(如Ubuntu 20.04)及驱动环境(CUDA、cuDNN等),或自行安装。

- 网络设置:配置安全组(开放SSH、HTTP等端口),绑定弹性公网IP以便远程访问。

连接与登录服务器

- SSH连接:

ssh username@服务器公网IP

- 远程桌面(Windows):通过RDP协议连接,适用于图形化操作。

部署开发环境

- 安装驱动与工具包:

- NVIDIA驱动:确保GPU可被识别。

- CUDA Toolkit:提供GPU并行计算接口。

- cuDNN:优化深度学习库性能。

- 配置Python环境:

conda create -n myenv python=3.8 pip install tensorflow-gpu torch

运行任务与监控

- 提交任务:通过脚本或Jupyter Notebook启动计算任务。

- 资源监控:

- 使用

nvidia-smi查看GPU利用率、显存占用。 - 云平台控制台提供CPU、内存、网络流量的实时监控。

- 使用

释放或保存资源

- 任务完成后:及时关闭实例或释放GPU资源,避免产生额外费用。

- 数据备份:将结果保存至云存储(如OSS、S3),防止数据丢失。

GPU云服务器的核心优势

- 弹性扩展:根据业务需求动态调整算力,应对突发流量。

- 成本优化:按小时或按需计费,无需承担硬件维护费用。

- 全球部署:通过云服务商的多区域节点降低网络延迟。

- 安全可靠:提供数据加密、灾备恢复等企业级安全方案。

注意事项

- 成本管理:

- 设置预算告警,避免超额消费。

- 长期任务可选择包年包月套餐降低成本。

- 数据安全:

定期备份数据,启用防火墙和访问控制。

- 环境兼容性:

确保代码、库版本与GPU驱动匹配,避免兼容性问题。

- 合规性:

遵守云服务商的使用政策,禁止用于挖矿等违规场景。

GPU云服务器降低了高算力任务的门槛,无论是企业还是个人开发者,均可通过简单的配置快速启动复杂计算,通过合理选型、规范操作和持续优化,GPU云服务器能显著提升效率,成为数字化转型的强力助手。

引用说明

- NVIDIA CUDA文档:https://docs.nvidia.com/cuda/

- 阿里云GPU实例指南:https://help.aliyun.com/

- AWS EC2用户手册:https://aws.amazon.com/cn/ec2/