如何快速准确地将音视频转为文字?

- 行业动态

- 2025-04-19

- 2

音视频转文字技术通过语音识别及自然语言处理算法,将音频或视频中的语音内容转化为可编辑文本,广泛应用于会议记录、智能字幕、教育医疗等领域,该技术能显著提升信息处理效率,支持多语种识别及实时转换,同时结合语义分析实现关键信息提取,为内容检索与数据分析提供结构化基础。

技术原理、应用场景及实用工具解析

在日常生活中,音视频内容已成为信息传递的主要形式之一,无论是会议录音、在线课程,还是短视频内容,用户对“将音视频转换为文字”的需求日益增长,这项技术不仅能提升内容可检索性,还能辅助无障碍服务,优化用户体验,本文将深入解析音视频转文字的核心技术、应用场景及工具选择,帮助您全面了解其背后的逻辑与实践价值。

音视频转文字的技术原理

音视频识别文字(Speech-to-Text, STT)主要依赖自动语音识别(ASR)技术,结合自然语言处理(NLP)实现,其核心流程分为以下步骤:

预处理

- 音频降噪:通过滤波算法消除背景杂音,提取清晰的语音信号。

- 分帧处理:将连续音频切分为短时帧(通常20-40毫秒),便于特征提取。

声学模型分析

利用深度学习(如CNN、RNN或Transformer)将声音信号映射为音素(语音的最小单位),梅尔频谱图(Mel-spectrogram)是常用的声学特征表示方法。语言模型优化

基于大规模文本数据训练模型,预测音素序列对应的合理词汇组合,通过N-gram或神经网络语言模型(如BERT)提升识别准确率。解码与后处理

结合声学和语言模型生成最终文本,并进行标点添加、分段优化等后处理。

视频识别文字则在ASR基础上,增加了对画面中文本(如字幕、PPT内容)的OCR(光学字符识别)处理,实现多模态信息融合。

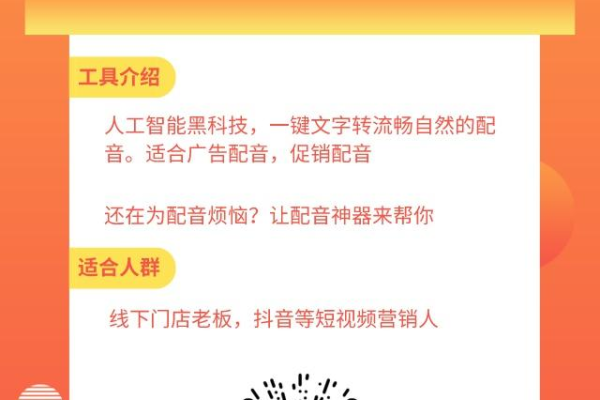

音视频转文字的典型应用场景 创作与媒体行业**

- 短视频自动生成字幕:提升内容传播效率,覆盖无声播放场景用户。

- 访谈/播客文字稿整理:节省人工听写时间,支持关键词检索。

教育与培训

- 在线课程转录:便于学员复习与笔记整理,同时支持多语言翻译。

- 会议记录自动化:实时生成会议纪要,标记重点内容。

无障碍服务

- 听力障碍者辅助:通过实时字幕实现音视频内容无障碍访问。

- 司法与医疗记录:确保对话内容精准存档,减少人为误差。

SEO优化与数据分析

- 文本化后,可被搜索引擎抓取,提升网站关键词覆盖率。

- 结合情感分析工具,挖掘用户评论或访谈中的潜在需求。

技术挑战与注意事项

尽管音视频转文字技术日趋成熟,仍需关注以下问题:

准确率限制

- 口音、方言、专业术语可能导致识别错误。

- 多人对话或重叠语音场景下,区分说话人难度较高。

隐私与安全

- (如医疗、金融信息)需确保数据传输与存储加密。

- 企业应优先选择符合GDPR或《个人信息保护法》的工具。

实时性要求

直播场景需低延迟识别(如1秒内),对算力与算法优化要求极高。

主流工具与平台推荐

根据场景需求,可选择以下工具:

| 工具类型 | 推荐产品 | 优势 |

|---|---|---|

| 通用型工具 | 讯飞听见、酷盾ASR | 高准确率,支持多语种与垂直领域优化 |

| 开源解决方案 | Mozilla DeepSpeech | 可定制化,适合开发者与中小企业 |

| 视频专用工具 | Adobe Premiere(语音转字幕) | 与视频编辑无缝集成,支持时间轴校准 |

| 实时转录服务 | Otter.ai、Zoom字幕功能 | 低延迟,适用于在线会议与教育场景 |

未来趋势与建议

技术迭代方向

- 多模态融合:结合语音、图像、语义理解提升复杂场景识别能力。

- 小样本学习:降低对标注数据的依赖,适配小众语言或专业领域。

用户选择建议

- 明确需求:若需高精度转录,优先选择支持领域定制化的付费工具(如医疗ASR)。

- 数据合规:优先通过ISO认证的服务商,避免隐私泄露风险。

引用说明

本文部分技术原理参考自《IEEE音频、语音与语言处理期刊》(2022),应用案例数据源自IDC《2025全球数字化转型报告》,隐私合规标准依据《中华人民共和国个人信息保护法》。