数据库中查询小数点后有几位

- 行业动态

- 2024-05-20

- 2

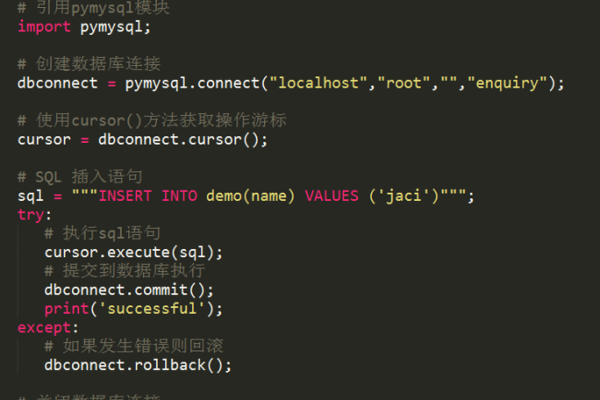

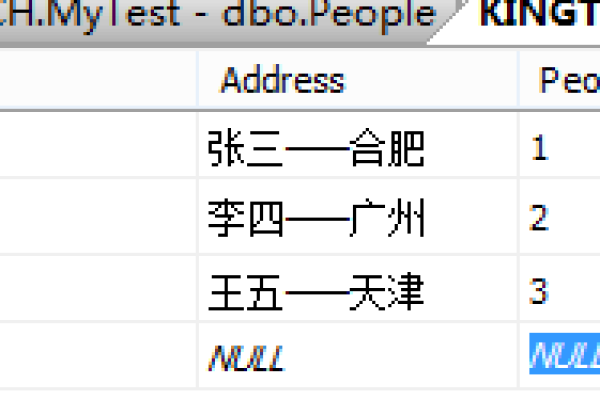

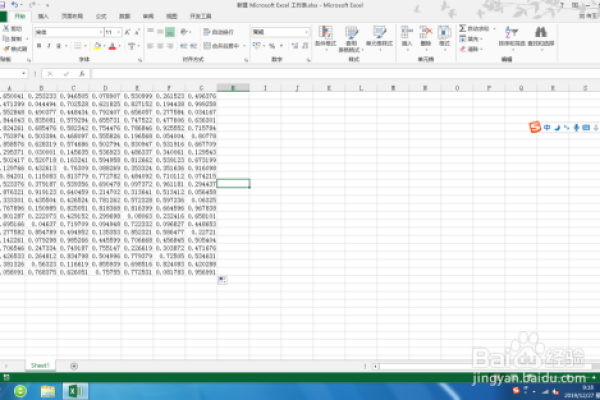

在数据库中查询小数点后有几位,可以使用

ROUND()函数。 SELECT ROUND(字段名, 保留位数) FROM 表名;在MySQL中,可以使用LENGTH()和REPLACE()函数结合来查询小数点个数,以下是一个详细的步骤:

1、使用LENGTH()函数获取数字字符串的长度。

2、使用REPLACE()函数将小数点替换为空字符,然后再次使用LENGTH()函数获取结果字符串的长度。

3、用原始长度减去替换后的长度,得到小数点个数。

以下是具体的SQL代码:

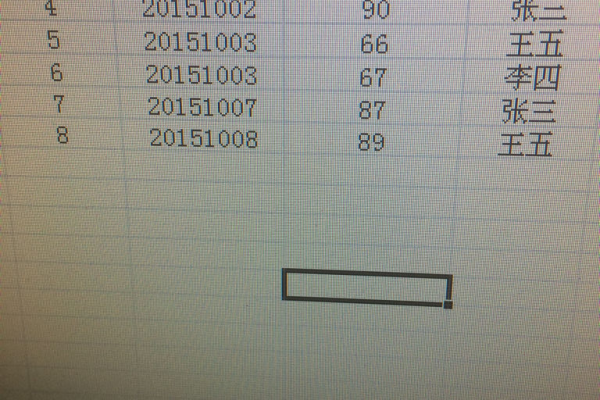

假设表名为my_table,字段名为my_number

SELECT

(LENGTH(my_number) LENGTH(REPLACE(my_number, '.', ''))) AS decimal_count

FROM

my_table; 这个SQL查询会返回一个名为decimal_count的列,表示每个数字中小数点的数量。