mysql索引数据结构类型

- 行业动态

- 2024-05-20

- 6

MySQL索引数据结构类型有B树、哈希表、R树等,其中B树是最常用的一种。

MySQL索引数据结构类型主要有以下几种:

1、BTree索引

2、哈希索引

3、空间数据索引(RTree)

4、全文索引(FullText Index)

5、聚簇索引(Clustered Index)

6、二级索引(Secondary Index)

下面分别详细介绍这些索引数据结构类型。

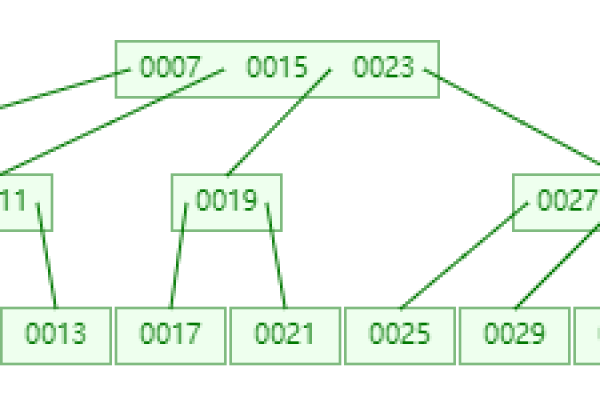

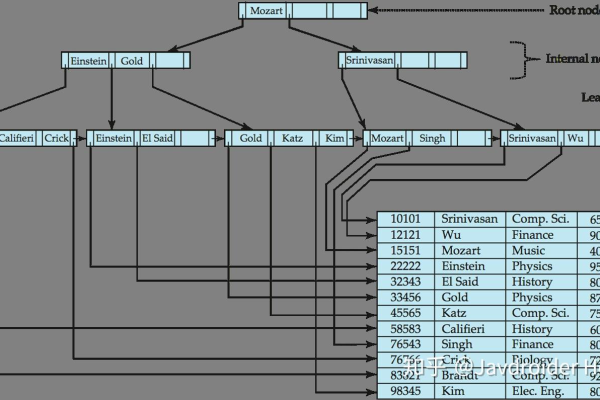

1、BTree索引

BTree是一种自平衡的多路搜索树,用于存储数据库中的数据,它具有高度平衡性,可以有效地提高查询速度,BTree索引适用于全值匹配和范围查询。

| 属性 | 描述 |

| 叶子节点 | 存储实际的数据记录 |

| 非叶子节点 | 存储指向子节点的指针 |

| 层级 | BTree的高度决定了查询性能,一般建议为35层 |

| 查询 | 支持全值匹配、范围查询和排序操作 |

| 插入 | 在叶子节点插入新记录,如果需要扩展则向上分裂 |

| 删除 | 如果删除后叶子节点小于阈值,则合并相邻叶子节点,否则向上合并 |

2、哈希索引

哈希索引是基于哈希函数实现的,它将数据根据哈希值进行组织,哈希索引适用于等值查询,但不支持范围查询和排序操作。

| 属性 | 描述 |

| 哈希桶 | 根据哈希函数将数据分配到不同的桶中 |

| 冲突解决 | 使用链表或开放寻址法解决哈希冲突 |

| 查询 | 支持等值查询,但不支持范围查询和排序操作 |

| 插入 | 直接插入到对应的哈希桶中 |

| 删除 | 直接从哈希桶中删除记录 |

3、空间数据索引(RTree)

空间数据索引主要用于地理信息系统(GIS)中的多边形、点和线等几何对象的空间查询,RTree是一种平衡树结构,可以有效地处理空间数据的插入、删除和查询操作。

| 属性 | 描述 |

| MBR(Minimum Bounding Rectangle) | 每个节点包含一个最小边界矩形,用于表示空间对象的区域范围 |

| 层次结构 | RTree具有多层节点,每层节点代表不同精度的空间划分 |

| 查询 | 支持空间对象的包含关系查询、相交关系查询和邻接关系查询 |

| 插入 | 根据空间对象的MBR将其插入到合适的节点中 |

| 删除 | 根据空间对象的MBR从相应的节点中删除记录 |

4、全文索引(FullText Index)

全文索引主要用于文本数据的快速检索,它通过分词器将文本数据分解为单词,然后建立倒排索引,以提高查询速度,全文索引支持模糊查询和同义词查询。

| 属性 | 描述 |

| 分词器 | 将文本数据分解为单词的工具 |

| 倒排索引 | 根据单词建立的索引结构,用于快速查找包含特定单词的文档 |

| 查询 | 支持模糊查询(如LIKE、MATCH AGAINST)和同义词查询(如FUZZY、WILDCARD) |

| 插入 | 在插入文档时,更新倒排索引中的相关记录 |

| 删除 | 在删除文档时,更新倒排索引中的相关记录 |

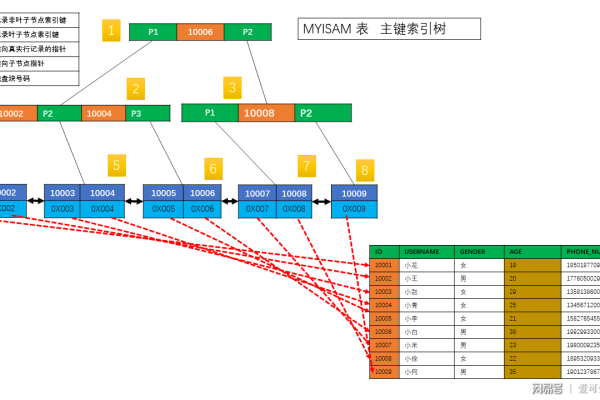

5、聚簇索引(Clustered Index)

聚簇索引是将数据记录按照主键的顺序存储在一起,形成一个连续的数据块,主键值相同的记录会相邻存储,聚簇索引适用于频繁按主键进行查询的场景。

| 属性 | 描述 |

| 数据记录顺序 | 根据主键值的顺序存储数据记录 |

| BTree结构 | 使用BTree作为底层数据结构,维护主键的顺序关系 |

| 查询性能 | 如果经常按主键进行查询,聚簇索引可以提高查询性能 |

| 插入性能 | 如果表中没有主键冲突,插入性能较好;如果有主键冲突,需要调整记录顺序,性能较差 |

| 删除性能 | 如果表中有大量重复的主键值,删除性能较差;如果没有重复的主键值,删除性能较好 |