Linux程序服务之间有何本质区别?

- 行业动态

- 2024-09-14

- 7

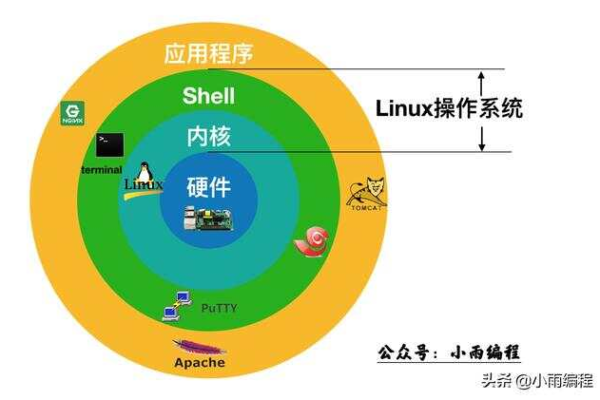

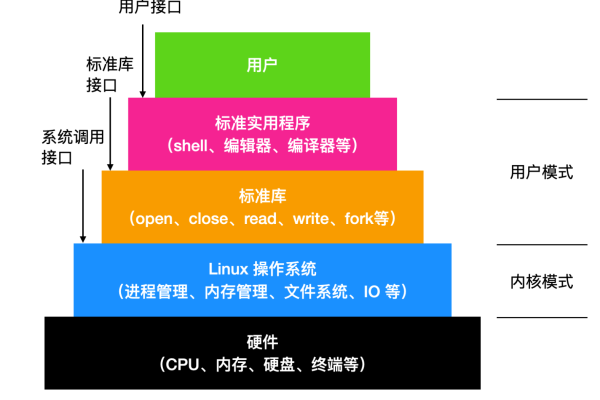

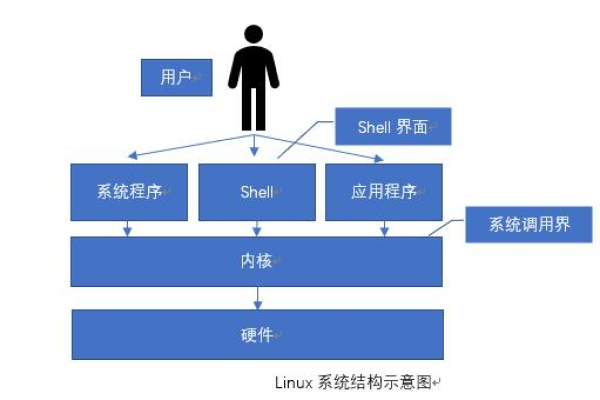

在Linux操作系统中,程序和服务是两个基本且重要的概念,程序是一系列指令的集合,它是静态的代码组成,本身并不执行任何操作,而服务则是系统中持续运行的程序,通常在后台运行,负责提供各种系统或网络功能,服务与普通程序的区别在于服务的运行模式和它们在系统中承担的角色,本文将深入探讨Linux中的程序和服务之间的区别,并介绍如何管理这些服务。

1、程序与服务的基本定义

程序:程序是一系列的代码和指令,当被执行时,它会变成一个或多个进程,程序是静态的,存储在磁盘上,直到被操作系统加载和执行。

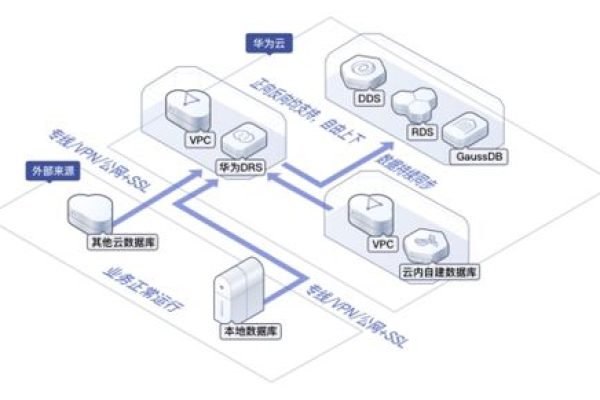

服务:服务是一种长期运行的程序,通常在后台运行,独立于用户的登录和交互,服务通常监听端口或执行定期任务,如Web服务器、数据库服务等。

2、进程与服务的区别

进程的特性:进程是程序的一次执行实例,它是动态的,具有独立的内存空间和PID(进程ID),进程结束后,它所占用的资源将会被释放。

服务的特性:服务设计为持续运行,即使用户注销或系统重启,服务也会自动重新启动,服务通常作为守护进程运行,不与任何终端会话关联。

3、启动和管理服务的方式

使用systemd:在现代Linux发行版中,systemd是最流行的初始化系统,用于替代传统的init.d,通过systemctl命令,可以方便地启动、停止、重启服务以及查看其状态。

使用service命令:传统的服务管理方式是使用service命令,它可以启动、停止、重启服务,并且查询服务的状态。

4、服务的配置和自动启动设置

配置文件:大多数服务有自己的配置文件,通常位于/etc/下的相关目录中,配置这些文件可以改变服务的运行行为和参数。

自动启动:在Linux系统中,可以通过systemctl enable命令使服务在系统启动时自动运行,这确保了关键服务始终可用,无需手动干预。

5、服务的安全性和依赖性管理

运行级别:服务可以根据系统的运行级别来控制其启动情况,某些服务只在系统完整启动后才开始运行。

依赖关系:大型服务可能依赖于其他服务或组件,systemd能够处理这些依赖关系,确保服务按正确的顺序启动。

Linux中的程序和服务虽然都是执行代码的实体,但它们在功能和运行方式上有很大的区别,理解这些差异对于有效地管理Linux系统至关重要,通过正确的工具和方法,管理员可以确保服务的稳定性和可靠性,从而支持整个系统的稳定运行。