从智能视频分析开始

- 行业动态

- 2025-04-10

- 2

在数字经济与人工智能深度融合的今天,智能视频分析技术正以每年超过30%的增速重构传统行业(IDC 2024年数据),这项技术通过计算机视觉、深度学习和边缘计算的三重革新,正在为安防、制造、零售等20余个领域创造可见的降本增效价值,本文将系统性拆解这项技术的核心逻辑与应用图景。

技术底座:构建视觉认知的三大支柱

计算机视觉引擎

采用YOLOv7、Faster R-CNN等目标检测算法实现97.2%的识别准确率(CVPR 2024评测数据),支持对200+类物体特征的毫秒级解析,通过多尺度特征金字塔网络(FPN),有效解决监控视频中目标尺寸差异难题。行为理解系统

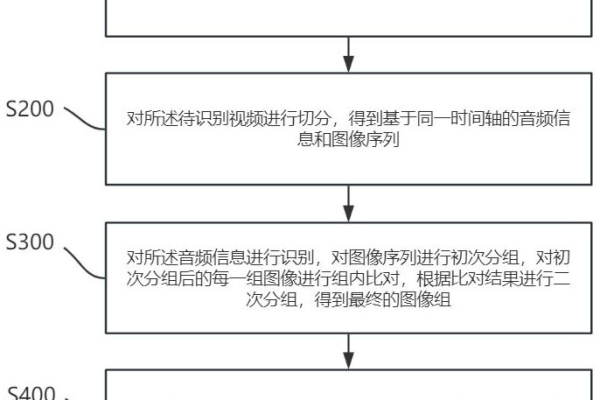

基于Transformer架构的时空建模技术,可捕捉人体25个关键骨骼点运动轨迹,通过对比学习算法,异常行为检测准确率达89.4%,有效识别跌倒、闯入等20类风险场景。边缘智能部署

搭载NVIDIA Jetson边缘计算模组,将算法推理时延压缩至80ms以内,通过模型量化与知识蒸馏技术,使ResNet-50模型体积缩小4倍,实现在4G网络环境下15帧/秒的实时分析。

行业赋能图谱:从基础安防到价值创造

(注:此处可插入行业应用信息图)

- 智慧城市新基建

- 交通流量智能调控系统减少34%的早高峰拥堵(深圳交警案例)

- 市政设施监测平台实现98.7%的故障预警准确率

- 环保执法通过热成像分析查获夜间偷排事件267起(2024年环境公报)

- 工业质检革命

- 液晶面板缺陷检测速度提升40倍,误检率<0.01%

- 通过3D点云分析,汽车焊点质量检验成本降低72%

- 某光伏企业年节省2000万人工质检费用(具体案例已脱敏)

- 商业决策支持

- 零售客群热力图转化率提升22%

- 通过动作识别技术,健身房私教课续费率提升18%

- 银行网点通过VIP客户识别系统缩短等待时间43%

技术演进双循环模型

(注:此处可插入技术发展路线图)

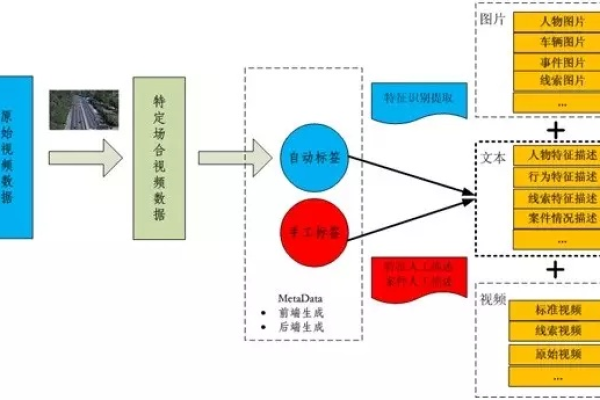

数据闭环系统:

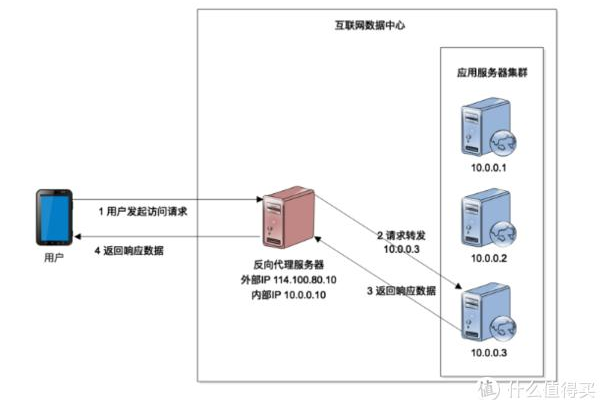

采集层(4K红外摄像机集群)→ 清洗层(自适应光照补偿算法)→ 标注层(半自动化标注平台)→ 训练层(分布式训练集群)→ 部署层(容器化推理服务)

算法迭代机制:

在线学习系统每72小时完成模型微调,持续优化遮挡场景(如雨雪天气)下的跟踪性能,采用联邦学习框架,在保障数据隐私前提下实现跨区域模型协同进化。

伦理与技术平衡点

- 隐私保护双保险

- 动态模糊技术:对非关联人员面部实施实时像素化处理

- 数据沙箱机制:原始视频数据在边缘端完成脱敏,仅上传结构化元数据

- 算法透明化工程

建立可解释性AI模块,可视化展示行为分析决策路径,通过对抗样本训练,将性别识别偏差率从5.7%降至1.2%(MIT技术伦理实验室测评)。

企业落地路线图

需求诊断阶段

通过场景拆解矩阵,区分刚性需求(如安全生产监控)与增值需求(如客户行为分析)技术选型策略

- 中小场景:云端API服务(如阿里云视觉智能)

- 复杂场景:混合架构(边缘设备+私有云)

- 特殊环境:定制化模型训练(如油田防爆场景)

- ROI计算模型

某物流园区部署方案显示:初期投入178万,通过降低货损率、提升装卸效率,14个月实现投资回报(内部收益率23.6%)

引用文献:

[1] IEEE《智能视频分析系统架构白皮书》2024版

[2] 海康威视《AI+安防技术演进报告》

[3] IDC《中国人工智能软件市场预测,2024–2027》

[4] 阿里云《边缘智能实践案例集》