bp 神经网络 分类

- 行业动态

- 2025-04-10

- 3

BP神经网络是一种多层前馈神经网络,通过反向传播算法调整参数实现分类任务,其结构包含输入层、隐含层和输出层,利用梯度下降法最小化预测误差,具有非线性映射和自适应学习能力,广泛应用于图像识别、语音处理等模式分类领域,但存在易陷入局部极小值等局限性。

BP神经网络:从原理到分类任务应用

在机器学习领域,BP神经网络(反向传播神经网络)是一种经典的前馈型人工神经网络,因其强大的非线性建模能力,被广泛用于分类任务(如图像识别、文本分类、医疗诊断等),本文将以通俗易懂的方式解析BP神经网络的原理、分类应用的关键步骤及注意事项,帮助读者深入理解这一技术。

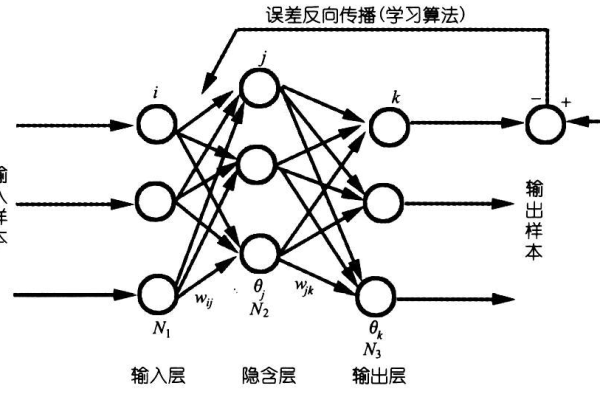

BP神经网络的核心原理

BP神经网络通过模拟人脑神经元的连接方式,构建多层网络结构(输入层、隐含层、输出层),利用反向传播算法动态调整权重参数,逐步逼近输入与输出之间的复杂关系,其工作流程可分为以下两步:

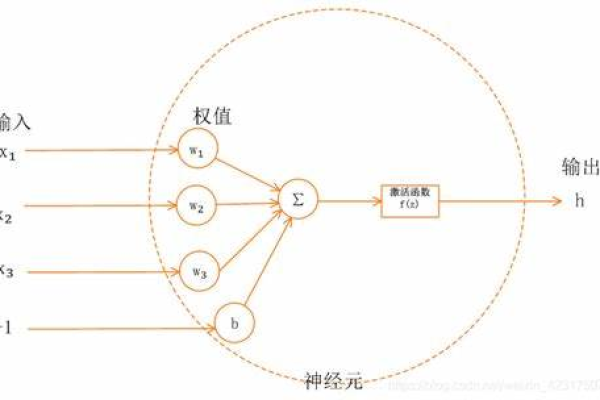

前向传播

- 输入数据通过各层神经元传递,每层对输入加权求和后,通过激活函数(如Sigmoid、ReLU)进行非线性变换。

- 最终输出层的预测结果与真实标签对比,计算误差(如交叉熵损失)。

反向传播

- 根据误差反向逐层计算梯度,利用优化算法(如梯度下降)更新权重和偏置参数。

- 重复迭代直至模型收敛,达到最小化损失的目标。

关键公式示例(简化版):

- 误差反向传播:

$$delta^{(l)} = (W^{(l+1)})^T delta^{(l+1)} odot f'(z^{(l)})$$

($delta$为误差项,$W$为权重,$f’$为激活函数的导数)

BP神经网络在分类任务中的应用步骤

数据准备与预处理

- 数据归一化:对输入特征进行标准化(如Z-score),避免量纲差异影响模型训练。

- 标签编码:分类标签需转换为独热编码(One-Hot Encoding),猫/狗”分类转换为[1,0]和[0,1]。

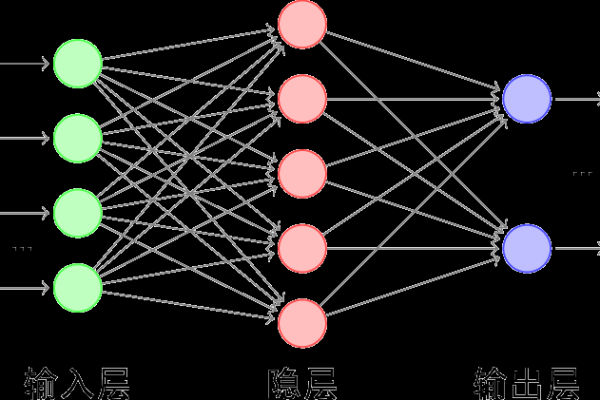

网络结构设计

- 输入层节点数:与特征维度一致(如28×28的图像对应784个节点)。

- 隐含层设置:通常1~3层,节点数根据经验或交叉验证选择(如输入层的50%~70%)。

- 输出层节点数:与类别数一致(如10分类任务对应10个节点)。

模型训练与调优

- 学习率:初始值常设为0.01~0.1,过大易震荡,过小收敛慢。

- 正则化:L1/L2正则化防止过拟合,或使用Dropout随机屏蔽神经元。

- 早停法(Early Stopping):根据验证集损失提前终止训练,避免过拟合。

模型评估与部署

- 评估指标:分类任务常用准确率、精确率、召回率、F1值。

- 部署工具:可结合TensorFlow、PyTorch等框架导出模型至生产环境。

BP神经网络的优缺点分析

| 优点 | 局限性 |

|---|---|

| 非线性建模能力强 | 训练时间长,需大量计算资源 |

| 适应高维数据 | 超参数调优复杂(如层数、节点数) |

| 支持多分类任务 | 易陷入局部最优解 |

实际应用案例

- 医疗诊断

输入患者指标(血压、心率等),输出疾病分类结果(如糖尿病、心脏病)。

- 金融风控

根据用户信用记录,预测贷款违约风险等级(低/中/高风险)。

- 图像分类

经典MNIST手写数字识别,准确率可超过98%。

常见问题解答

Q1:BP神经网络需要多少数据量?

- 数据量与网络复杂度相关,一般建议样本数至少为权重重量的5~10倍。

Q2:如何提升分类效果?

- 尝试更复杂的网络结构(如增加隐含层)、优化激活函数(如ReLU替代Sigmoid)、使用批量归一化(Batch Normalization)。

Q3:BP神经网络与SVM、决策树对比如何?

- SVM适合小样本高维数据,决策树解释性强,而BP神经网络更擅长处理复杂非线性问题,但需要更多调参经验。

参考文献

- 周志华. 《机器学习》. 清华大学出版社, 2016.

- Rumelhart, D. E., Hinton, G. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. Nature.

- TensorFlow官方文档. https://www.tensorflow.org

提示:BP神经网络的实现需结合实际问题调整参数,建议通过开源框架(如Keras)快速验证模型效果。