dl什么服务器

- 行业动态

- 2025-01-30

- 8

DL服务器,即深度学习服务器,是专门为深度学习任务而设计的高性能计算机系统,以下是关于DL服务器的详细回答:

一、定义与用途

DL服务器是一种配置强大的服务器,专为深度学习算法和模型设计,它通过模拟人脑神经网络的结构和功能,对大量数据进行训练和学习,从而实现识别、分类、预测等人工智能任务,DL服务器广泛应用于图像识别、语音识别、自然语言处理等领域,为这些领域提供了强大的计算支持。

二、特点

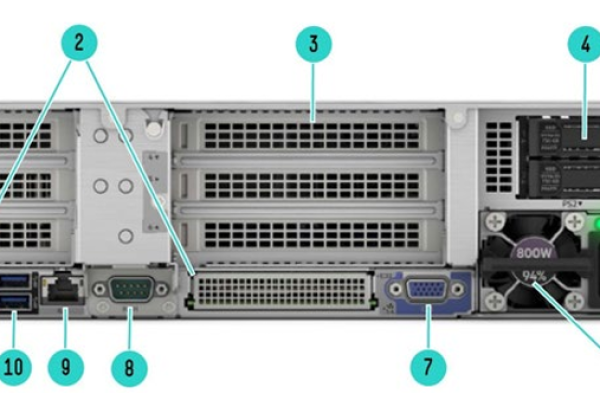

1、强大的计算能力:DL服务器通常配备高性能的多核处理器和GPU等硬件,以满足深度学习模型对于大规模计算的需求,特别是GPU,由于其拥有大量的计算核心和并行处理能力,可以极大地加速深度学习任务的执行速度。

2、大内存和存储容量:深度学习模型需要处理大量的数据和参数,因此DL服务器通常具备较大的内存容量和存储空间,以提供充足的资源支持。

3、高速网络连接:DL服务器需要与其他设备进行数据传输和通信,因此具有高速的网络连接是必要的,DL服务器采用高速的以太网连接,以保证数据的快速传输。

4、软件支持:DL服务器上常常安装有各种深度学习框架和工具,如TensorFlow、PyTorch等,以便开发人员直接使用这些软件进行深度学习任务的开发和执行。

5、易于管理和维护:DL服务器通常配备专门的服务器管理软件,可以对服务器进行远程管理、监控和维护,这些软件能够提供系统状态监测、故障检测和自动修复等功能,提高服务器的可靠性和稳定性,减少维护成本和人工干预。

三、类型

1、GPU服务器:大多数DL服务器都配备了多个高性能的GPU,如NVIDIA的Tesla系列,用于加速深度学习模型的训练和推理过程。

2、CPU服务器:一些小型或简单的DL任务也可以在CPU上运行,CPU服务器通常具有更高的性价比,适用于一些轻量级的DL应用。

3、FPGA服务器:FPGA(现场可编程门阵列)可以根据特定的计算需求进行定制化配置,从而提供更高的计算性能和能效,FPGA服务器适合于那些需要定制化硬件加速的DL任务。

4、TPUs服务器:TPU(Tensor Processing Unit)是由谷歌开发的专用于机器学习的芯片,具有强大的浮点计算能力和高速的内存带宽,TPU服务器专为在谷歌云平台上运行DL任务而设计,与其他服务器相比,具有更高的性能和能效。

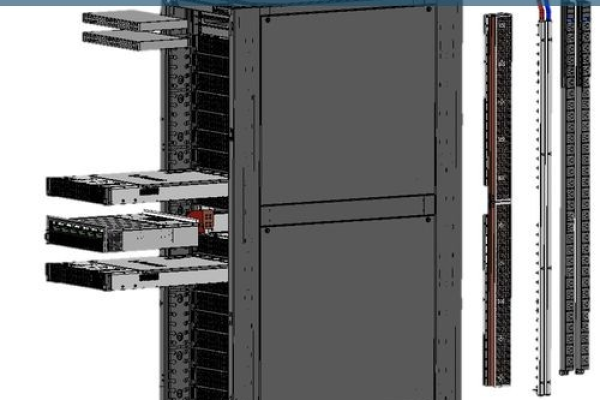

5、分布式服务器集群:对于大规模的DL训练任务,通常需要多台服务器组成一个集群来分布式处理,分布式服务器集群可以提供更大的计算能力和存储容量,从而加速DL模型的训练过程。

四、操作流程

1、安装和配置操作系统:DL服务器通常使用Linux操作系统,如Ubuntu、CentOS等,在安装操作系统时,应选择适合硬件配置和软件支持的版本,并进行基本的系统配置。

2、安装和配置深度学习框架:根据需要安装相应的深度学习框架,并进行必要的配置和依赖项安装,可以使用包管理工具(如pip、conda)来简化安装过程。

3、安装和配置GPU驱动和库:根据所选择的GPU和深度学习框架,安装对应的GPU驱动和库,如CUDA驱动和cuDNN库。

4、数据准备和预处理:DL算法通常需要大量的数据进行训练,因此需要将数据集准备好并进行预处理,这包括数据清洗、数据划分、数据增强等步骤。

5、模型设计和训练:根据具体任务的需求,设计合适的深度学习模型,并使用准备好的数据集进行训练,训练过程中,需要设置合适的超参数、损失函数和优化算法。

6、模型调优和验证:通过调整超参数、增加训练数据、改进模型结构等方式,对训练得到的模型进行优化和验证,可以使用交叉验证、学习曲线、混淆矩阵等方法评估模型性能。

7、模型部署和推理:训练完成后,将模型部署到DL服务器上,并使用实时或离线数据进行推理,推理过程中,可以利用DL库提供的并行计算能力和优化方法,提高推理速度和准确性。

8、监控和优化:在DL服务器运行的过程中,可以通过监控系统资源利用率、算法性能和模型效果等指标,进行优化和调整,可以使用工具和库来实时监控和可视化这些指标。

五、FAQs

1、Q: DL服务器与普通服务器有何不同?

A: DL服务器是专门为深度学习任务设计的,具有更高的计算能力、更大的内存和存储容量、以及更适合深度学习任务的软件支持,相比之下,普通服务器可能无法满足深度学习任务的高性能需求。

2、Q: 如何选择适合自己需求的DL服务器?

A: 选择DL服务器时需要考虑硬件要求、操作系统选择和DL框架配置等因素,建议根据自己的具体需求和预算进行选择,并咨询专业人士的意见。