如何编写负载均衡配置代码?

- 行业动态

- 2024-11-25

- 3198

在现代网络架构中,负载均衡是确保服务高可用性和优化资源使用的关键策略,通过合理配置负载均衡器,可以分散用户请求到多个服务器上,从而提高系统的响应速度和稳定性,本文将详细介绍如何配置一个基本的负载均衡系统,包括硬件和软件的选择、配置步骤以及常见问题解答。

一、负载均衡

负载均衡(Load Balancing)是一种计算机网络技术,用于分配工作负载以优化资源使用、最大化吞吐量、最小化响应时间,并避免任何单一资源的过载,它通常用于分配客户端的请求到一个或多个服务器上,这些服务器构成了一个服务器集群。

二、负载均衡的类型

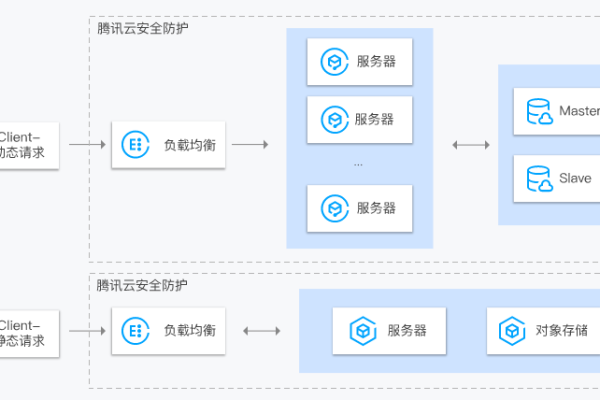

1、静态负载均衡:预先定义的规则来分配流量,不考虑实时的服务器状态。

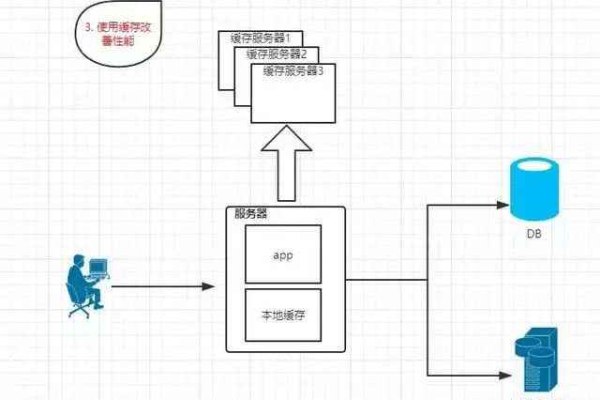

2、动态负载均衡:根据实时监控到的服务器性能指标(如CPU使用率、内存占用等)动态调整流量分配。

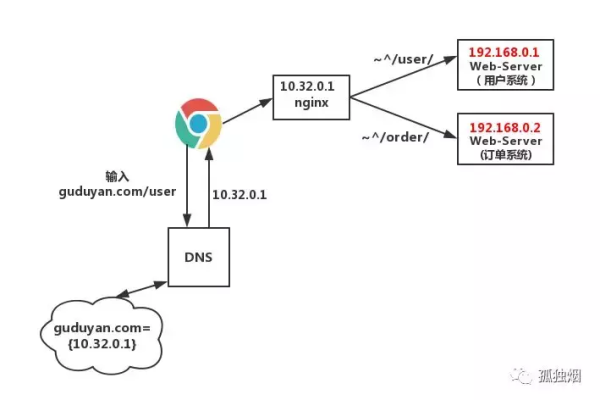

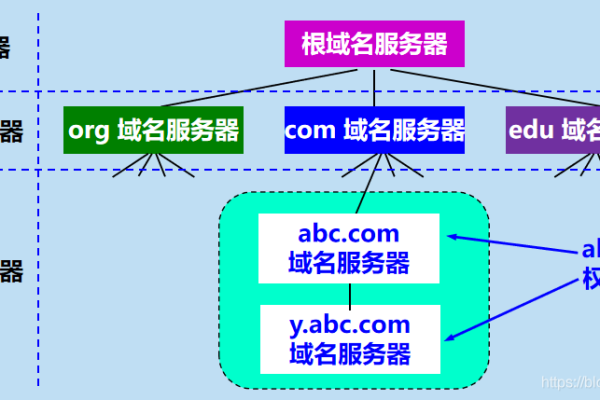

3、基于DNS的负载均衡:通过DNS解析将请求指向不同的IP地址,实现简单的负载均衡。

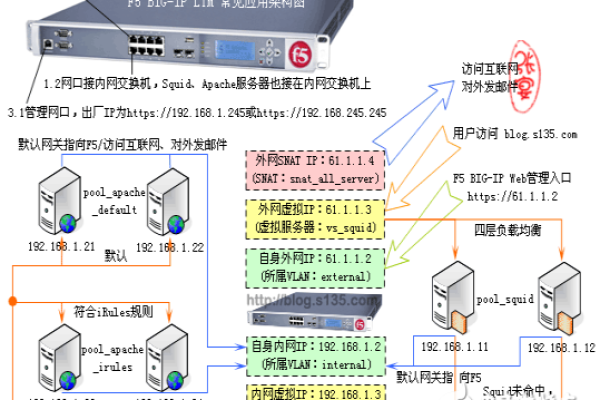

4、反向代理负载均衡:使用反向代理服务器接收客户端请求,然后将请求转发给后端服务器群中的一台或多台服务器。

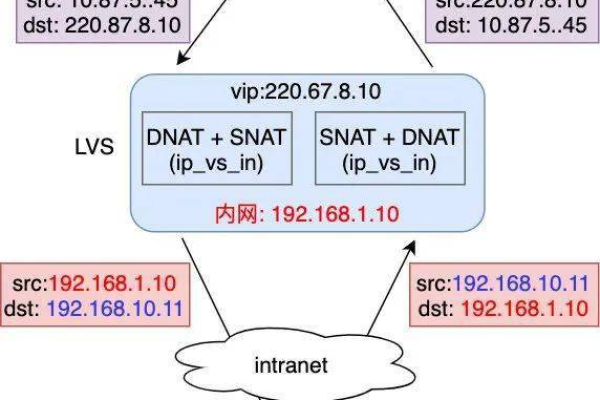

5、IP层负载均衡:工作在OSI模型的网络层,根据数据包的目标IP地址进行流量分配。

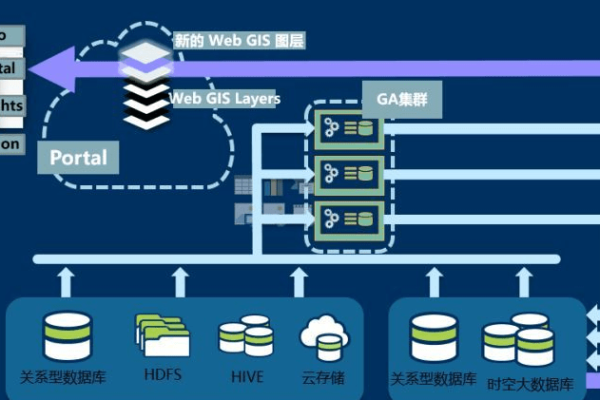

6、应用层负载均衡:工作在OSI模型的应用层,可以根据内容(如HTTP头信息)进行智能路由。

三、负载均衡算法

轮询(Round Robin):按顺序将请求分配给每个服务器。

加权轮询(Weighted Round Robin):考虑服务器的处理能力,权重高的服务器获得更多请求。

最少连接数(Least Connections):将请求发送到当前活动连接数最少的服务器。

源地址哈希(Source IP Hashing):根据请求者的IP地址进行哈希计算,确定由哪台服务器处理请求。

URL哈希(URL Hashing):根据请求的URL进行哈希计算,确保同一资源的请求总是被定向到同一台服务器。

四、负载均衡配置示例

以下是一个使用Nginx作为反向代理服务器进行负载均衡的配置示例:

http {

upstream backend {

server backend1.example.com weight=3;

server backend2.example.com;

server backend3.example.com;

}

server {

listen 80;

location / {

proxy_pass http://backend;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

}

}

}在这个配置中,我们定义了一个名为backend的上游服务器组,其中包括三个后端服务器,其中backend1.example.com被赋予了较高的权重,意味着它将处理更多的请求,我们设置了一个监听80端口的服务器块,并将所有进入的请求通过反向代理转发到backend服务器组。

五、FAQs

Q1: 如何更改Nginx负载均衡的策略?

A1: 在Nginx中更改负载均衡策略非常简单,你只需要修改upstream块中的配置即可,如果你想使用最少连接数策略,你可以添加least_conn指令:

upstream backend {

least_conn;

server backend1.example.com;

server backend2.example.com;

server backend3.example.com;

}Q2: 负载均衡器本身会成为单点故障吗?

A2: 是的,如果只有一个负载均衡器实例,那么它确实可能成为单点故障,为了解决这个问题,可以使用多个负载均衡器实例,并在前面放置另一个负载均衡器或者使用DNS轮询来分发流量到这些实例上,还可以考虑使用云服务提供商提供的弹性负载均衡解决方案,这些服务通常已经内置了高可用性机制。

小伙伴们,上文介绍了“负载均衡配置代码”的内容,你了解清楚吗?希望对你有所帮助,任何问题可以给我留言,让我们下期再见吧。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:http://www.xixizhuji.com/fuzhu/348015.html