如何有效利用MapReduce中的缓存文件来提升数据处理性能?

- 行业动态

- 2024-11-22

- 1

MapReduce 是一个用于处理大规模数据集的编程模型,它将任务分为两个阶段:Map(映射)和 Reduce(归约)。在 Map 阶段,输入数据被分成小块并进行处理;在 Reduce 阶段,处理结果被汇总。CacheFile 是 Hadoop 中的一个功能,允许用户将文件缓存到分布式文件系统(DFS)中,以便在 MapReduce 作业中使用。

MapReduce 分布式缓存机制

背景介绍

MapReduce是一种编程模型,用于大规模数据集(大于1TB)的并行运算,概念”Map”(映射)和“Reduce”(归约),与它们的主要思想,都是从函数式编程语言里借来的,还有从矢量编程语言里借来的特性,它极大地方便了编程人员在不会分布式并行编程的情况下,将自己的程序运行在分布式系统上,当前的软件实现是指定一个Map(映射)函数,用来把一组键值对映射成一组新的键值对,指定并发的Reduce(归约)函数,用来保证所有映射的键值对中的每一个共享相同的键组。

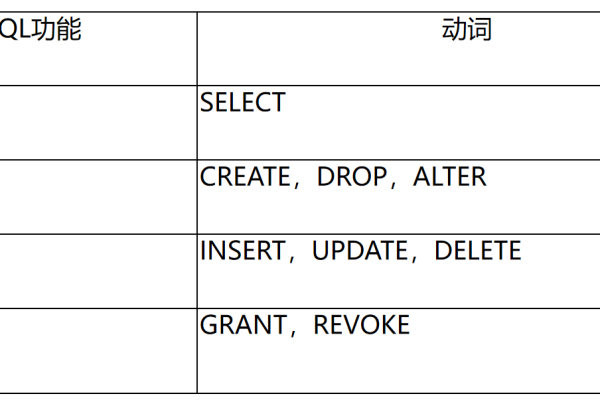

MapReduce工作原理

MapReduce将大规模数据处理作业分解为两个主要阶段:Map阶段和Reduce阶段,数据首先被分成独立的块,由多个Map任务并行处理,然后将Map阶段的输出结果进行排序和分区,再交由Reduce任务进行汇总处理,这种分而治之的策略能够显著提高数据处理的效率和可扩展性。

什么是DistributedCache

DistributedCache是Hadoop为MapReduce框架提供的一种分布式缓存机制,它将需要缓存的文件分发到各个执行任务的子节点的机器中,各个节点可以自行读取本地文件系统上的数据进行处理,这个机制特别适用于需要在多个任务之间共享只读数据的场景,如配置文件、字典文件或静态数据等。

使用场景

分发第三方库:例如jar包、so文件等,这些文件可以在任务运行时提供必要的依赖。

共享小文件:如配置文件或词典文件,这些文件在作业运行期间不会被修改,适合作为只读数据缓存。

Join操作优化:在进行大表和小表的关联操作时,可以将小表通过DistributedCache分发到各个节点,减少数据倾斜和网络传输开销。

中间结果数据传递:在某些复杂的作业中,中间结果数据可以通过DistributedCache传递到各个任务中,避免重复计算,减少计算时间。

使用方法

添加文件到DistributedCache

在Java API中,可以使用Job类的addCacheFile方法将文件添加到DistributedCache中。

Job job = Job.getInstance(conf);

job.addCacheFile(new URI("hdfs://namenode:9000/path/to/cache/file"), job.getConfiguration());在命令行参数中,也可以通过以下方式添加缓存文件:

hadoop jar myjob.jar com.example.MyJob -cacheFile hdfs://namenode:9000/path/to/cache/file#cached_file

访问缓存文件

在Map或Reduce函数中,通过Context类的getLocalCacheFiles方法获取缓存文件。

Path[] cacheFiles = DistributedCache.getLocalCacheFiles(context);

for (Path cacheFile : cacheFiles) {

// 使用cacheFile进行相关操作

}在Python API中,可以通过hadoop命令将文件从DistributedCache中提取到本地,然后进行读取操作。

配置参数

以下是一些常用的配置参数:

mapreduce.job.cache.files:指定要缓存的文件列表。

<property>

<name>mapreduce.job.cache.files</name>

<value>hdfs://namenode:9000/path/to/cache/file#cached_file</value>

</property>mapreduce.job.cache.files.timestamps:设置缓存文件的时间戳,以确保文件的最新版本被使用。

示例代码

以下是一个简单的MapReduce程序示例,演示如何使用DistributedCache进行小文件的缓存和读取操作。

Driver类

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class DistributedCacheExample {

public static void main(String[] args) throws Exception {

if (args.length != 3) {

System.err.println("Usage: DistributedCacheExample <input path> <output path> >");

System.exit(-1);

}

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "distributed cache example");

job.setJarByClass(DistributedCacheExample.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

// 添加缓存文件

job.addCacheFile(new URI("hdfs://namenode:9000/path/to/cache/file"), job.getConfiguration());

return job.waitForCompletion(true) ? 0 : 1;

}

}Mapper类

import java.io.BufferedReader;

import java.io.FileReader;

import java.io.IOException;

import java.util.HashMap;

import java.util.Map;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.lib.cache.DistributedCache;

import org.apache.hadoop.mapreduce.lib.input.FileSplit;

import org.apache.hadoop.mapreduce.Mapper.Context;

public class TokenizerMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Map<String, String> n_map;

@Override

protected void setup(Context context) throws IOException, InterruptedException {

Path[] cacheFiles = DistributedCache.getLocalCacheFiles(context);

if (cacheFiles != null && cacheFiles.length > 0) {

Path cacheFile = cacheFiles[0];

BufferedReader br = new BufferedReader(new FileReader(cacheFile));

String line;

while ((line = br.readLine()) != null) {

String[] fields = line.split("t");

n_map.put(fields[0], fields[1]);

}

br.close();

}

}

@Override

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String line = value.toString();

String[] fields = line.split("\s+");

for (String field : fields) {

if (n_map.containsKey(field)) {

context.write(new Text(n_map.get(field)), one);

} else {

context.write(new Text(field), one);

}

}

}

}Reducer类

import java.io.IOException;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

public class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

@Override

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}在这个示例中,我们首先在Driver类中通过job.addCacheFile方法将缓存文件添加到DistributedCache中,然后在Mapper类的setup方法中读取缓存文件,并将其存储在一个HashMap中,在map方法中,我们对输入的每一行进行处理,并结合缓存文件中的数据进行相应的操作,Reducer类对Map阶段的输出进行汇总处理。

DistributedCache是MapReduce框架中的一个重要优化机制,通过将只读文件缓存到每个节点的本地文件系统中,减少了网络传输和HDFS读取的开销,提高了数据处理的效率,在使用DistributedCache时,需要注意文件大小的限制和只读属性,并根据具体的应用场景和需求进行合理的配置和使用,通过合理利用DistributedCache,可以大幅提升MapReduce作业的性能和资源利用率。

以上内容就是解答有关“mapreduce cachefile_MapReduce”的详细内容了,我相信这篇文章可以为您解决一些疑惑,有任何问题欢迎留言反馈,谢谢阅读。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:https://www.xixizhuji.com/fuzhu/342696.html