从文件读取导入数据库的问题

- 行业动态

- 2025-04-02

- 8

从文件读取导入数据库是一个常见的数据处理任务,它涉及将存储在文件中的数据提取出来并加载到数据库中,这个过程通常包括以下几个步骤:

确定数据源和目标数据库

数据源:首先需要明确数据的来源,这可能是一个CSV文件、Excel文件、JSON文件或者任何其他格式的文本文件。

目标数据库:确定数据将被导入到哪种类型的数据库中,例如MySQL、PostgreSQL、Oracle、SQL Server等。

准备数据

检查数据完整性:确保文件中的数据没有缺失值或错误。

数据清洗:对数据进行必要的清洗,比如去除多余的空格、转换数据类型等。

格式转换:如果必要,将数据转换为数据库可以识别的格式。

设计数据库模式

表结构设计:根据数据内容设计数据库表的结构,包括字段名、数据类型、约束条件等。

索引设计:为了提高查询效率,可能需要为某些字段创建索引。

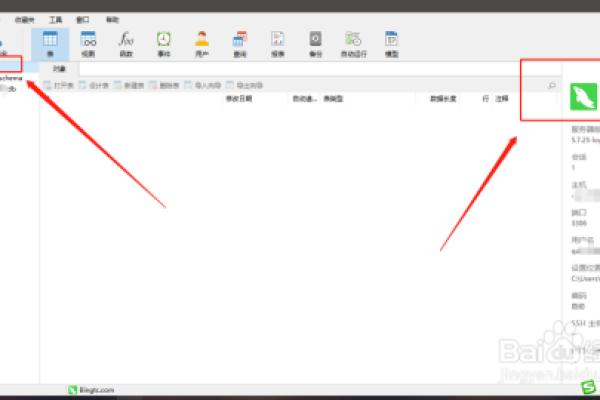

连接数据库

选择工具/库:根据目标数据库的类型,选择合适的数据库驱动或库来建立连接。

建立连接:使用相应的连接字符串和认证信息连接到数据库。

编写导入脚本

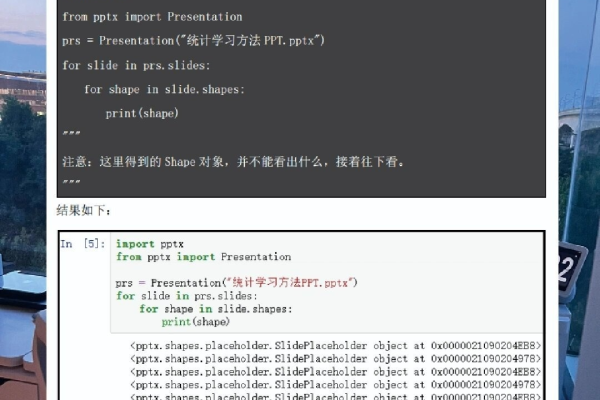

读取文件:使用适当的编程语言(如Python、Java、C#等)读取文件中的数据。

数据处理:对读取的数据进行处理,以符合数据库的要求。

插入数据:将处理后的数据插入到数据库中。

执行导入操作

测试:在正式导入前,先在测试环境中运行脚本,确保一切正常。

监控:在导入过程中监控系统性能和日志,确保没有错误发生。

验证:导入完成后,验证数据是否正确无误地存储在数据库中。

优化和维护

性能调优:根据需要调整数据库配置,优化查询性能。

备份:定期备份数据库,以防数据丢失。

维护:定期检查和维护数据库,确保其稳定运行。

以下是一个简化的示例,展示如何使用Python将CSV文件中的数据导入到MySQL数据库中:

import csv

import pymysql

连接到MySQL数据库

connection = pymysql.connect(host='localhost',

user='yourusername',

password='yourpassword',

database='yourdatabase')

cursor = connection.cursor()

打开CSV文件

with open('data.csv', 'r') as file:

reader = csv.reader(file)

next(reader) # 跳过标题行

for row in reader:

# 假设CSV文件有两列:name和age

sql = "INSERT INTO users (name, age) VALUES (%s, %s)"

cursor.execute(sql, (row[0], int(row[1])))

提交事务

connection.commit()

关闭连接

cursor.close()

connection.close()

相关问答FAQs

Q1: 如果CSV文件中包含大量数据,一次性导入可能会导致内存不足,应该怎么办?

A1: 可以将数据分批次导入,每次只处理一部分数据,这样可以避免内存不足的问题,也可以使用流式处理的方式,逐行读取和写入数据库,减少内存占用。

Q2: 如果遇到特殊字符或编码问题导致数据无法正确导入,应该如何解决?

A2: 首先尝试确认文件的编码格式,并在读取文件时指定正确的编码,对于特殊字符,可以使用数据库提供的转义序列或函数进行处理,如果问题依旧存在,可以考虑在导入前对数据进行预处理,替换或移除特殊字符。