从一个表格提取数据库数据库数据库

- 行业动态

- 2025-04-01

- 8

在当今数据驱动的世界中,从表格中提取数据库信息是一项常见且至关重要的任务,无论是企业进行数据分析、市场调研,还是科研机构处理实验数据,都离不开对表格数据的高效利用,以下将详细介绍如何从表格中提取数据库信息:

一、明确表格结构与数据需求

1、分析表格结构

首先要仔细研究表格的结构,包括其包含的列(字段)、每列的数据类型(如数值型、文本型、日期型等)以及各列代表的具体含义,一个销售数据表格可能包含“产品名称”“销售数量”“销售金额”“销售日期”等列,明确这些列的信息是后续准确提取数据的基础。

2、确定数据需求

根据具体的业务目标或分析目的,确定需要从表格中提取哪些数据,如果想了解某类产品在不同时间段的销售趋势,那就需要提取该产品对应的“产品名称”“销售日期”和“销售数量”等数据列。

二、选择合适的提取方法

1、手动提取(适用于小规模数据)

对于数据量较小的表格,可以采用手动复制粘贴的方式将所需数据提取出来,在一个只有几十行记录的简单表格中,直接选中要提取的单元格区域,复制后粘贴到新的文档或电子表格软件(如Excel)的指定位置即可,但这种方法效率较低,且容易出错,尤其是当数据量稍大或需要频繁提取时。

2、使用电子表格软件功能(适用于中小规模数据)

筛选功能:利用Excel等软件的筛选功能,可以根据特定条件快速筛选出符合要求的行数据,要提取销售金额大于1000元的记录,只需在“销售金额”列设置筛选条件为“大于1000”,然后选中筛选后的区域复制粘贴到新位置。

排序功能:通过排序可以将数据按照一定顺序排列,便于提取特定范围内的数据,按“销售日期”升序排序后,可轻松提取某个时间段内的数据。

数据透视表:对于需要进行复杂数据分析和汇总的情况,数据透视表是非常有用的工具,它可以根据指定的行、列标签对数据进行快速汇总和分析,然后将结果提取出来。

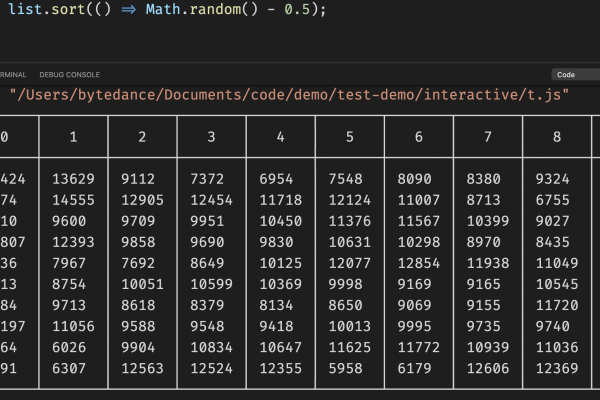

3、编写程序代码(适用于大规模数据)

当面对海量数据时,手动操作或使用电子表格软件的常规功能会变得非常低效,此时编写程序代码来提取数据是更好的选择,常见的编程语言如Python、R等都提供了丰富的库和函数来处理表格数据,以Python为例,可以使用Pandas库读取表格文件(如CSV、Excel格式),然后通过编写相应的代码逻辑来提取所需的数据,以下是一个简单的示例代码:

import pandas as pd

读取Excel文件

data = pd.read_excel('sales_data.xlsx')

提取特定列的数据

extracted_data = data[['产品名称', '销售数量', '销售日期']]

保存提取后的数据到新的Excel文件

extracted_data.to_excel('extracted_sales_data.xlsx', index=False)

上述代码首先使用pandas库的read_excel函数读取名为sales_data.xlsx的Excel文件,然后通过方括号索引提取“产品名称”“销售数量”和“销售日期”这三列的数据,最后使用to_excel函数将提取后的数据保存到新的Excel文件中。

三、数据清洗与验证

1、数据清洗

提取出来的数据可能包含一些无效值、重复值或格式不一致的问题,需要进行数据清洗,检查是否存在缺失值,并根据具体情况选择填充、删除或标记;去除重复的记录;统一数据格式,如将日期格式统一为“YYYY-MM-DD”。

2、数据验证

为确保提取的数据准确无误,需要对数据进行验证,可以通过与原始表格中的数据进行对比,检查提取的数据是否完整、正确;或者使用统计分析方法,如计算平均值、最大值、最小值等统计指标,看是否符合预期范围。

四、FAQs

问题1:如果表格中的列名存在空格或特殊字符,在使用程序代码提取数据时会有什么影响?

答:在使用程序代码提取数据时,如果表格中的列名存在空格或特殊字符,可能会导致代码无法正确识别列名,从而出现错误,在Python中使用Pandas库读取表格时,如果列名中有空格,需要在引用列名时加上引号并使用反引号(` `)来转义空格,如data[产品名称]`,对于特殊字符,也可能需要根据实际情况进行转义或替换,以确保代码能够正确运行并提取到所需数据。

问题2:当提取的数据量非常大时,如何提高数据处理的效率?

答:当提取的数据量非常大时,可以从以下几个方面提高数据处理的效率:一是优化代码算法,避免不必要的循环和计算,尽量使用高效的数据处理函数和方法;二是利用多线程或多进程技术,将数据处理任务并行化,同时在多个处理器核心上运行,加快处理速度;三是合理利用硬件资源,如增加内存、使用固态硬盘等,以提高数据的读写速度;四是对数据进行预处理,如压缩、分区等,减少数据处理的规模和复杂度,还可以考虑使用分布式计算框架(如Hadoop、Spark等)来处理超大规模的数据。