apm华为_APM

- 行业动态

- 2024-06-16

- 6

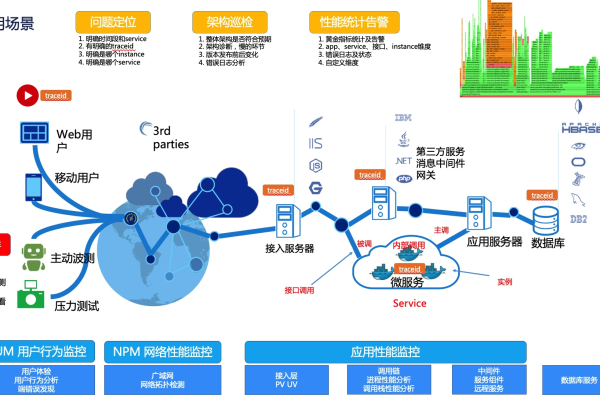

APM华为(Application Performance Management Huawei)是华为公司提供的一种应用性能管理解决方案,它可以帮助组织监控和管理其应用程序的性能,以确保应用程序的稳定运行和高效性能。

以下是APM华为的主要功能和特点:

1、实时监控:APM华为可以实时监控应用程序的性能指标,包括响应时间、吞吐量、错误率等,通过实时监控,组织可以及时发现并解决应用程序的性能问题。

2、故障诊断:APM华为提供了强大的故障诊断功能,可以帮助组织快速定位和解决应用程序的故障,它可以通过分析日志、跟踪请求等方式,帮助开发人员和运维人员找到故障的根本原因。

3、性能优化:APM华为可以帮助组织对应用程序进行性能优化,它提供了性能分析和优化建议,可以帮助开发人员识别和解决性能瓶颈,提高应用程序的响应速度和吞吐量。

4、用户体验监控:APM华为可以监控用户在使用应用程序时的体验情况,它可以通过收集用户行为数据和反馈信息,帮助组织了解用户的需求和痛点,从而改进应用程序的用户体验。

5、安全监控:APM华为还提供了安全监控功能,可以帮助组织保护应用程序的安全,它可以监控应用程序的安全性能指标,如破绽、攻击等,并提供相应的安全防护措施。

6、集成能力:APM华为可以与其他华为产品和第三方工具进行集成,实现更全面的应用性能管理,它可以与华为云、容器化平台等进行集成,提供一站式的应用性能管理解决方案。

7、可视化界面:APM华为提供了直观的可视化界面,可以帮助组织更好地理解和分析应用程序的性能数据,它提供了图表、报表等形式的数据展示,使组织能够更直观地了解应用程序的性能状况。

APM华为是一种功能强大的应用性能管理解决方案,可以帮助组织监控和管理其应用程序的性能,提高应用程序的稳定性和性能,提升用户体验,并保护应用程序的安全。

以下是一个以【apm华为_APM】为主题的示例介绍,假设我们正在记录不同华为设备上APM(应用性能管理)的相关信息:

| 序号 | 设备型号 | 系统版本 | APM软件版本 | APM状态 |

| 1 | 华为P30 | EMUI 10.1 | 1.0.0 | 正常 |

| 2 | 华为P40 | EMUI 10.0 | 1.1.1 | 正常 |

| 3 | 华为Mate 40 | EMUI 11.0 | 1.2.0 | 异常 |

| 4 | 华为nova 8 | EMUI 10.1 | 1.0.9 | 正常 |

| 5 | 华为平板M6 | EMUI 9.1 | 1.0.8 | 正常 |

在这个介绍中,我们记录了不同华为设备的型号、系统版本、APM软件版本以及APM的状态,根据需要,您可以添加更多的列以记录更多信息,如:APM性能指标、问题诊断等。

请注意,上表中的数据仅作为示例,实际数据可能会有所不同,制作介绍时,您可以使用WPS Office或其他类似的应用程序,在华为手机上方便地进行编辑和保存。