云主机有什么用,云主机的作用

- 行业动态

- 2023-12-10

- 6

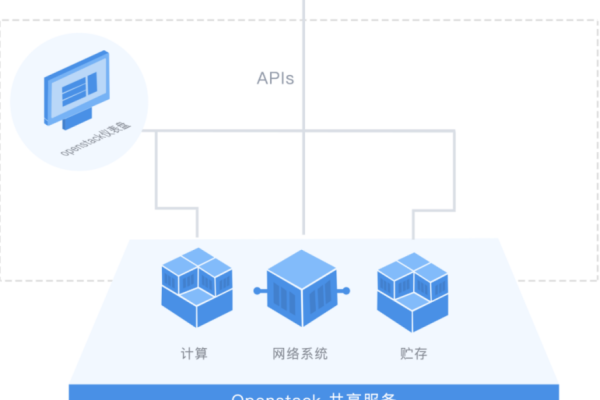

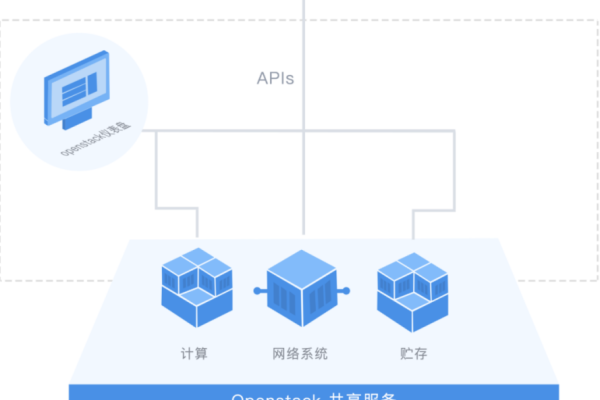

云主机,又称云计算服务器,是一种基于互联网的计算服务,它将计算资源、存储资源、网络资源等通过虚拟化技术整合在一起,为用户提供按需使用的计算服务,云主机的出现极大地方便了企业和个人用户在互联网上进行业务操作,降低了IT设备的投入成本,提高了运维效率,本文将详细介绍云主机的作用及其优势。

一、云主机的作用

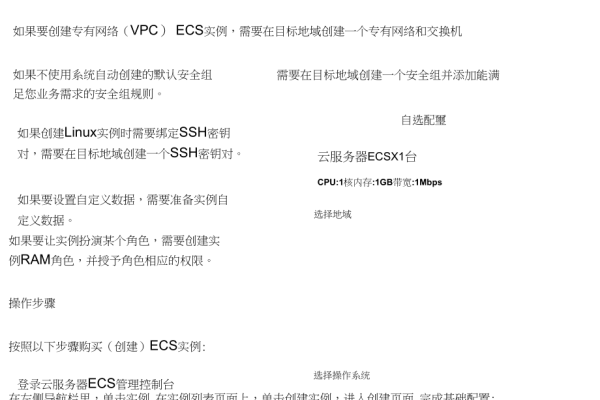

1、弹性扩展:云主机可以根据用户的需求,随时增加或减少计算资源,实现弹性扩展,这意味着用户无需担心硬件资源不足的问题,可以随时根据业务需求调整计算资源。

2、高可用性:云主机采用分布式架构,数据和应用程序分布在多个服务器上,即使某个服务器出现故障,其他服务器仍然可以正常运行,保证了服务的连续性和稳定性。

3、快速部署:云主机支持快速部署,用户只需在线申请,系统会自动为其分配资源,短时间内即可完成业务的搭建和上线。

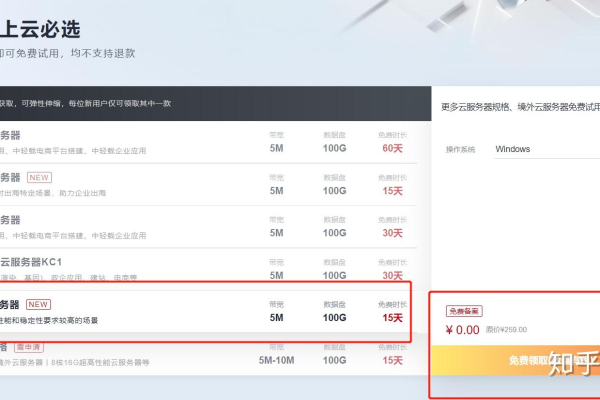

4、节省成本:相较于传统的物理服务器,云主机可以大大降低硬件设备的投入成本,云主机采用按需付费的方式,用户只需支付实际使用的计算资源费用,无需为闲置资源付出成本。

5、数据安全:云主机提供多重安全保障,包括数据备份、数据加密、防火墙等,确保用户数据的安全可靠,云主机还提供实时监控和报警功能,帮助用户及时发现并解决潜在的安全问题。

6、灵活管理:云主机支持多种操作系统和应用程序,用户可以根据自己的需求选择合适的配置,云主机提供了丰富的管理工具,如远程控制、日志查看、性能监控等,方便用户对服务器进行实时管理和维护。

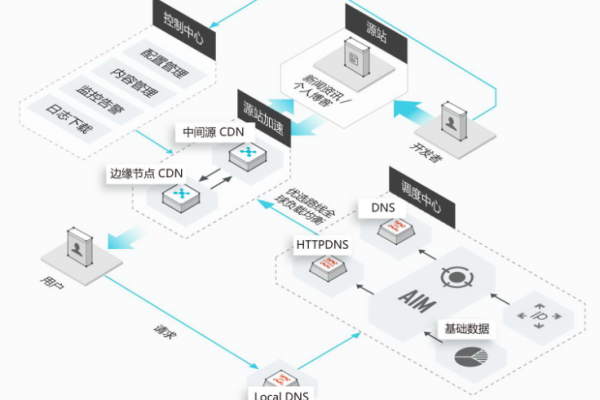

7、跨平台访问:云主机可以实现多台服务器之间的负载均衡,用户可以通过不同的设备和浏览器访问其业务系统,提高了用户体验。

二、云主机的优势

1、弹性伸缩:云主机可以根据业务需求自动调整资源配置,实现弹性伸缩,降低了企业的运营成本。

2、高可用性:云主机采用分布式架构,数据和应用程序分布在多个服务器上,提高了系统的稳定性和可用性。

4、按需付费:云主机采用按需付费的方式,用户只需支付实际使用的计算资源费用,无需为闲置资源付出成本。

5、数据安全:云主机提供多重安全保障,确保用户数据的安全可靠。

6、灵活管理:云主机支持多种操作系统和应用程序,提供了丰富的管理工具,方便用户对服务器进行实时管理和维护。

三、相关问题与解答

1、云主机是否安全?

答:云主机本身具有一定的安全性,但用户在使用过程中仍需注意保护好自己的数据和应用,定期更新操作系统和应用程序、设置强密码、开启防火墙等措施都可以提高云主机的安全性,云服务提供商通常会提供额外的安全防护措施,如数据备份、加密等,以确保用户数据的安全。

2、云主机如何实现跨平台访问?

答:云主机通过负载均衡技术实现跨平台访问,负载均衡器会根据用户的请求自动分配到可用的服务器上,从而实现跨平台访问,用户可以通过不同的设备和浏览器访问其业务系统,提高了用户体验。

3、云主机如何实现弹性伸缩?

答:云主机通过动态调整计算资源来实现弹性伸缩,当用户业务量增加时,云主机会自动增加相应的计算资源;当用户业务量减少时,云主机会自动减少相应的计算资源,这样可以确保用户在不同业务阶段都能获得足够的计算资源支持。

4、云主机如何实现按需付费?

答:云主机通过预付费方式或者后付费方式实现按需付费,预付费方式是指用户在购买云主机时预先支付一定金额的费用;后付费方式是指用户在使用完云主机后按照实际使用的时间和资源支付费用,这种方式可以帮助用户更好地控制成本,避免因为闲置资源而导致的浪费。