探究服务器并发量的上限与优化方法实验报告

- 行业动态

- 2024-02-01

- 4363

实验报告分析了服务器并发量上限,并提出优化策略以提升性能。

服务器并发量的上限与优化方法

在互联网服务中,服务器的并发量是衡量服务能够同时处理多少用户请求的重要指标,一个高并发的系统可以支持更多用户同时使用服务,而不至于出现延迟或崩溃,本文将探讨服务器并发量的上限及其优化方法。

服务器并发量上限因素

服务器并发量的上限受多种因素影响,主要包括硬件资源(CPU、内存、磁盘I/O)、网络带宽、软件架构以及数据库性能等,具体来说:

1、硬件资源:服务器的CPU核心数和频率、内存大小和速度、磁盘I/O能力直接决定了服务器处理请求的能力,硬件资源越强,理论上并发处理能力越高。

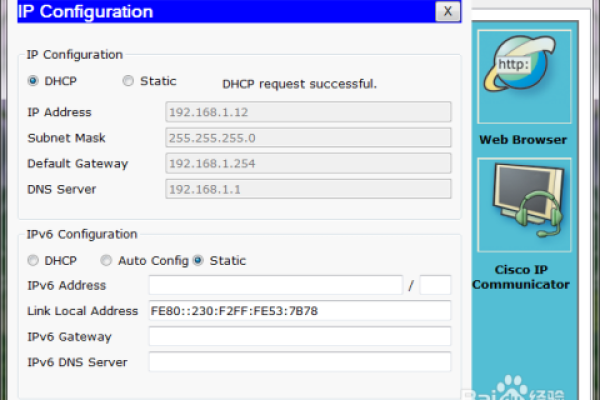

2、网络带宽:服务器的网络带宽决定了数据流入流出的速度,如果带宽不足,即使服务器计算能力足够,也会因数据传输瓶颈而导致并发量受限。

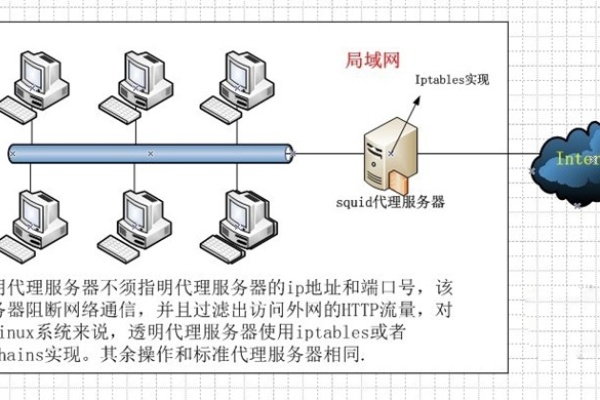

3、软件架构:软件的设计和架构对并发处理能力有重要影响,良好的异步处理机制、负载均衡、缓存策略等都能显著提高并发处理能力。

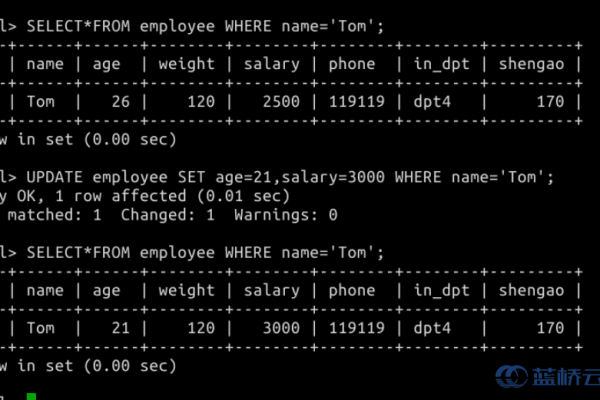

4、数据库性能:数据库是大多数应用的瓶颈所在,数据库的查询效率、索引优化、连接池管理等都会影响并发量。

服务器并发量优化方法

针对上述影响因素,以下是一些常见的服务器并发量优化方法:

1、硬件升级:提升服务器的硬件配置,如增加CPU核心数、扩充内存、使用SSD硬盘等,可以直接提高服务器的处理能力。

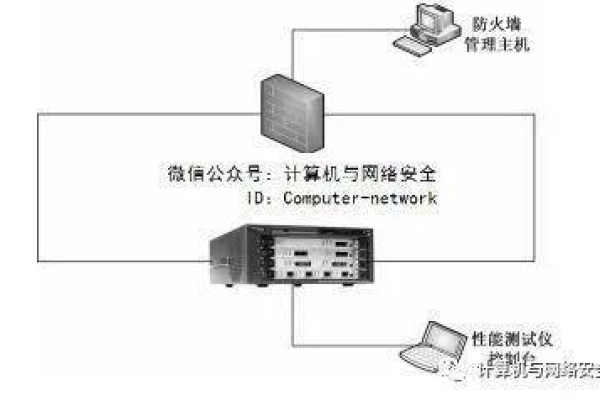

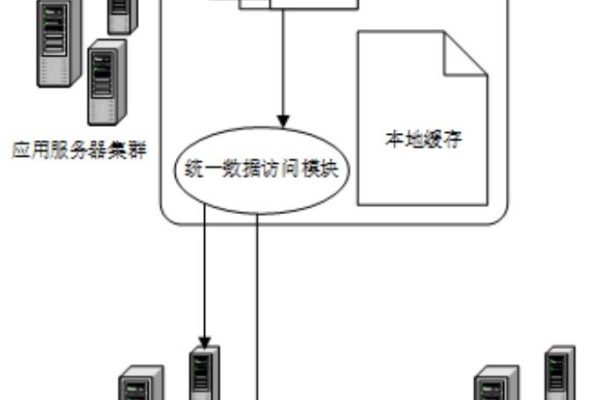

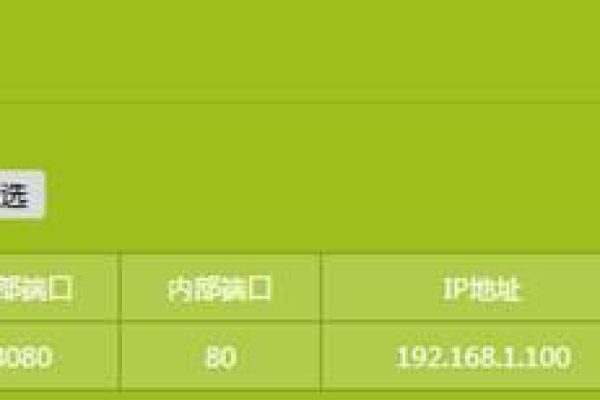

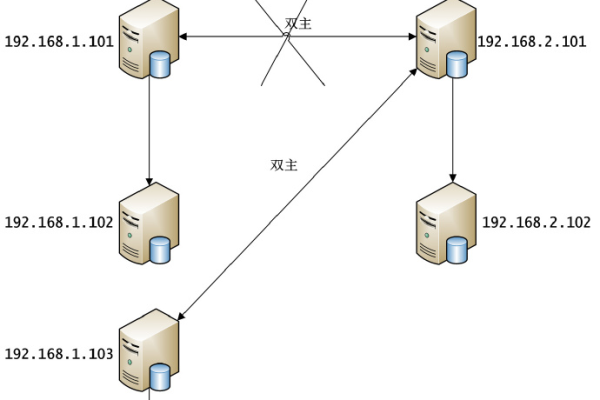

2、负载均衡:通过负载均衡技术将请求分散到多台服务器上,不仅可以提高并发处理能力,还能提高系统的可用性。

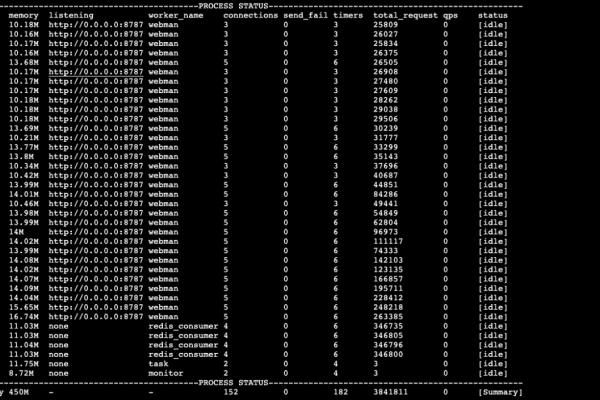

3、缓存应用:使用内存缓存如Redis、Memcached等,可以减少对数据库的直接访问,从而减轻数据库压力,提高响应速度。

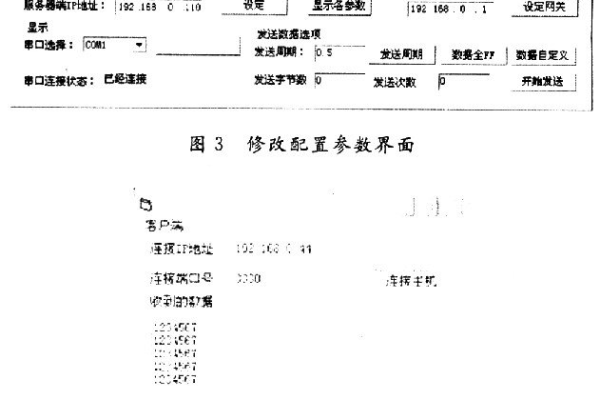

4、数据库优化:优化数据库查询,合理设计索引,使用连接池等技术可以减少数据库的负载,提高并发处理能力。

5、异步处理:对于不需要即时响应的请求,可以采用消息队列等异步处理机制,减少请求等待时间,提高系统吞吐量。

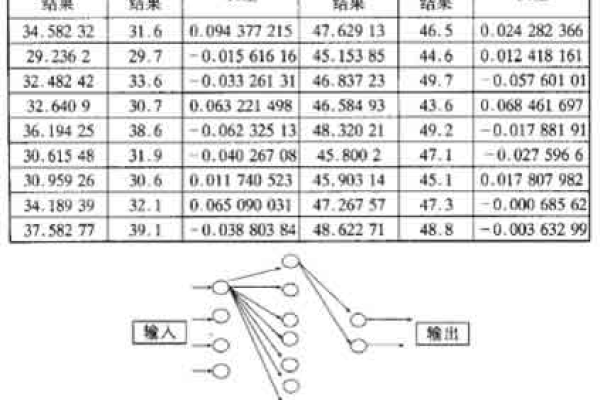

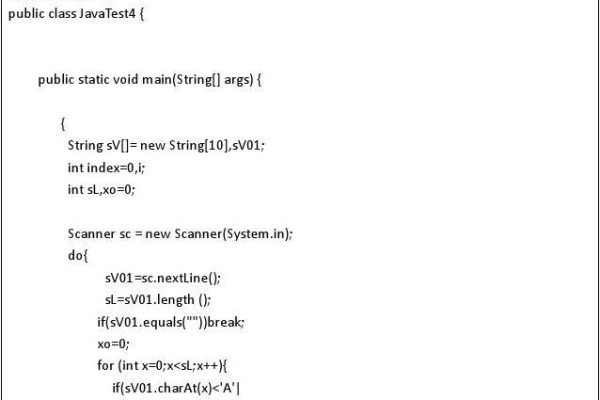

6、代码优化:优化程序代码,减少不必要的计算和内存使用,可以提高单个请求的处理速度,从而提高并发量。

7、使用微服务架构:将大型应用拆分为多个小型服务,每个服务独立部署和扩展,可以提高系统的灵活性和并发处理能力。

相关问题与解答

Q1: 如何判断服务器的并发量是否达到上限?

A1: 可以通过监控服务器的CPU使用率、内存使用量、磁盘I/O、网络带宽等指标来判断,当这些指标接近或达到最大承载能力时,表明并发量已接近上限。

Q2: 负载均衡是否会增加系统的复杂性?

A2: 是的,负载均衡会引入额外的管理和维护工作,但它是提高并发处理能力和系统可用性的有效手段。

Q3: 缓存机制是否会导致数据一致性问题?

A3: 是的,缓存可能会引起数据一致性问题,在使用缓存时需要设计合理的更新和失效策略,确保数据的一致性。

Q4: 微服务架构是否会增加系统的开发和维护难度?

A4: 微服务架构确实会增加系统的复杂性,但它提供了更好的模块化、独立性和可扩展性,对于大型复杂应用来说,这些优势往往超过了它带来的挑战。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:https://www.xixizhuji.com/fuzhu/306260.html