impala打开hdfs文件报错

- 行业动态

- 2024-03-22

- 1

Impala在打开HDFS文件时遇到报错,通常是由于配置问题、HDFS状态问题或者权限问题导致的,以下针对这些常见问题,提供详细的解答。

我们需要了解Impala与HDFS的交互原理,Impala是一个基于Hadoop的大数据查询引擎,它可以直接读取HDFS上的数据进行分析,当Impala打开HDFS文件时,需要确保以下方面正确无误:

1、配置问题

Impala依赖于HDFS的配置信息,如dfs.domain.socket.path,如果该配置不正确或Impala没有权限访问该路径,会导致Impala无法启动或读取HDFS数据。

解决方案:

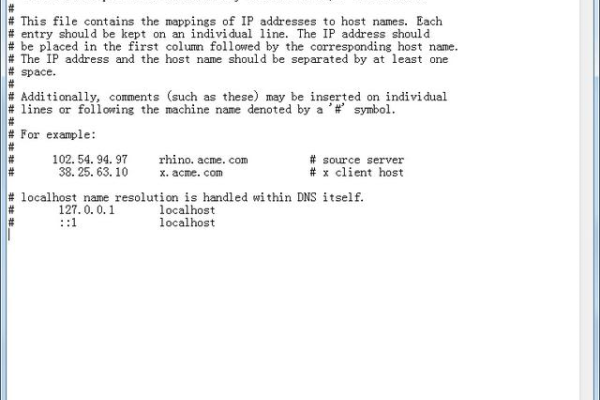

确认HDFS配置文件(如hdfssite.xml)中的dfs.domain.socket.path配置是否正确。

检查该路径是否已创建,如果未创建,需要手动创建并设置相应权限。

“`

mkdir pv /var/run/hdfssockets/dn

chmod 777 /var/run/hdfssockets/dn

“`

修改完成后,重启Impala服务。

2、HDFS NameNode状态问题

当HDFS的NameNode处于Standby状态时,某些操作(如读取、写入数据)可能无法执行。

解决方案:

确认HDFS的NameNode状态,如果其中一个NameNode处于Standby状态,请尝试切换到Active状态。

修改Impala表或分区的location,使用HDFS的nameservice名称,而不是具体的NameNode IP地址。

“`

alter table counterparquet set location ‘hdfs://nameservice1/user/hive/warehouse/counterparquet’;

“`

修改完成后,重新加载表或重启Impala服务。

3、权限问题

如果Impala没有足够的权限访问HDFS上的文件或目录,也会导致报错。

解决方案:

检查HDFS上目标文件或目录的权限,确保Impala用户(通常为impala)有读取权限。

如果权限不足,可以使用HDFS命令修改权限,

“`

hdfs dfs chmod 755 /path/to/directory

“`

修改完成后,重新尝试打开文件。

4、HDFS文件数量限制

HDFS默认对单个目录下的文件数量有限制(2.10.x版本的默认值为1,048,576),当超过该限制时,无法在该目录下写入新的文件。

解决方案:

使用HDFS命令检查目标目录下的文件数量,

“`

hdfs dfs count /path/to/directory

“`

如果需要减少单目录内的文件数量,可以采取以下措施:

将文件分散到多个目录。

通过修改NameNode的配置参数(如dfs.namenode.fslimits.maxdirectoryitems)并重启NameNode,提高目录文件数量限制。

使用终极方案,修改NameNode参数并重启NameNode。

当Impala打开HDFS文件时遇到报错,我们需要从多个方面进行分析和解决,首先确认配置是否正确,然后检查HDFS NameNode的状态和权限问题,还需注意HDFS文件数量限制,确保没有超过规定的上限,通过逐一排查并解决问题,相信Impala打开HDFS文件的报错问题将得到妥善处理。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:http://www.xixizhuji.com/fuzhu/199270.html