云主机如何拨号

- 行业动态

- 2024-02-19

- 3

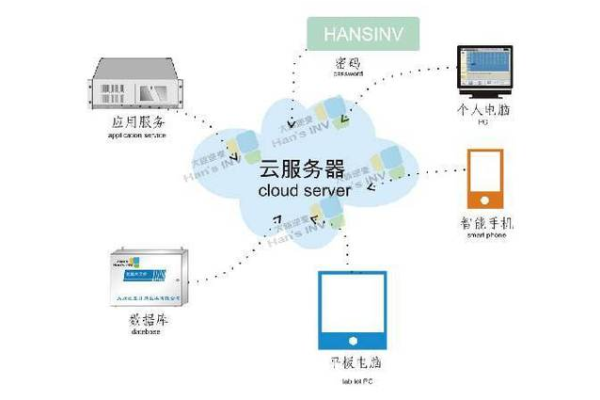

云主机通常不直接拨号上网,而是通过配置在虚拟私有网络(网络传输层)或专线接入互联网。用户需设置好网络接口,分配IP地址,并确保云服务商提供相应的网络连通性服务。

云主机如何拨号

云主机,也称为虚拟私有服务器(Virtual Private Server, VPS),是通过虚拟化技术在物理服务器上划分出多个相互隔离的虚拟环境,这些虚拟环境各自拥有独立的操作系统、计算资源和网络配置,使得用户可以像使用传统物理服务器一样进行各种操作,在某些情况下,用户可能需要对云主机进行网络拨号操作,以访问特定的网络服务或资源,以下是如何在云主机上进行拨号操作的技术介绍:

了解拨号需求

首先需要明确为何要在云主机上执行拨号操作,常见的原因包括访问受地域限制的网络资源、使用动态IP地址以绕过某些限制或是连接特定的网络传输层服务等。

选择合适的云服务商

选择一个提供拨号支持的云服务商是至关重要的,不是所有的云服务提供商都允许在其云主机上进行拨号操作,因此在选择服务商时需要确认其服务条款中有相关的支持说明。

创建云主机实例

在云服务商平台上创建一个云主机实例时,确保为其分配足够的资源,如CPU、内存和带宽,以便顺利执行拨号任务,选择合适的操作系统,例如Linux或Windows,因为不同的系统拨号方式会有所不同。

配置网络接口

在云主机实例中,通常需要配置一个或多个网络接口,对于拨号操作,往往需要设置一个公网IP地址,并且确保该IP地址具有外网访问权限,还需要根据所用协议(如PPP)配置相应的网络接口参数。

安装拨号软件

根据云主机的操作系统,安装相应的拨号软件或客户端,在Linux系统中,可以使用内置的pppd(Point-to-Point Protocol Daemon)软件包;而在Windows系统中,则可以通过网络连接向导来设置拨号连接。

配置拨号连接

在拨号软件中配置拨号连接,这包括输入拨号所需的用户名、密码、电话号码以及可能的其他认证信息,确保这些信息准确无误,以便成功建立拨号连接。

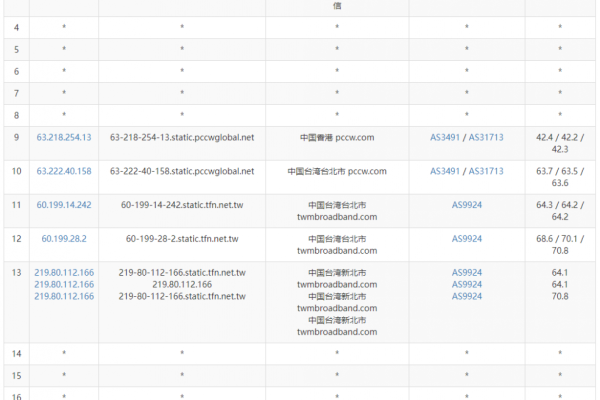

测试拨号连接

完成以上步骤后,进行拨号连接的测试,通过命令行或者拨号软件的用户界面发起拨号请求,并观察是否能成功连接到目标网络,若出现错误,检查日志文件以定位问题所在。

监控和维护

一旦拨号连接建立成功,定期监控云主机的网络状态和性能指标,以确保连接的稳定性,必要时,更新配置或重启拨号服务来解决可能出现的问题。

相关问题与解答

Q1: 云主机拨号时出现连接失败怎么办?

A1: 检查拨号配置信息是否正确,包括用户名、密码和电话号码,查看云主机的网络日志以确定是否有其他错误信息,假如问题依旧无法解决,联系云服务商的技术支持寻求帮助。

Q2: 是否可以在云主机上同时运行多个拨号连接?

A2: 理论上是可以的,但实际能否运行多个拨号连接取决于云主机的网络接口数量和操作系统的支持情况,需要注意的是,同时运行多个拨号连接可能会对系统资源造成较大压力。

Q3: 使用云主机拨号是否会影响其他服务的性能?

A3: 拨号操作会占用一定的系统资源,包括CPU和网络带宽,假如云主机的资源有限,同时进行的拨号操作可能会影响其他服务的性能,合理分配资源非常重要。

Q4: 云主机的拨号IP是否会频繁更换?

A4: 通常情况下,除非断开并重新建立拨号连接,否则拨号IP地址不会频繁更换,某些云服务商可能会为每次拨号操作分配一个新的IP地址,具体情况需咨询服务商。