ai服务器操作系统

- 行业动态

- 2025-03-16

- 7

AI服务器操作系统是专为支持人工智能应用而设计的服务器 操作系统,它需要具备强大的计算能力、高效的并行处理能力和良好的可扩展性。以下是一些常见的 AI服务器操作系统:1. Linux系列, Ubuntu Server:广泛使用的开源操作系统之一,在AI领域应用广泛。具有稳定性和安全性高的特点,适用于运行大规模的AI工作负载和深度学习任务。, CentOS Server:基于Red Hat Enterprise Linux(RHEL)源代码构建的开源操作系统,性能强大且稳定,适用于企业级的AI应用场景。, Anolis OS:国内开源操作系统根社区龙蜥推出的操作系统,全面兼容国内外主流CPU、GPU架构,对AI场景大量使用的AI框架提供原生支持,适配更新、更丰富、更安全的AI容器服务生态。2. Windows Server系列, 微软公司推出的服务器操作系统,适用于企业环境。对于习惯使用Windows平台的开发者和研究人员,提供了与Windows桌面操作系统相似的用户界面和可视化管理工具,方便进行系统集成和开发。AI服务器操作系统的选择多样,不同的操作系统在功能、性能、易用性和安全性等方面各有特点,用户可根据自身需求和硬件配置选择合适的操作系统来搭建和管理AI服务器。

AI服务器操作系统

一、

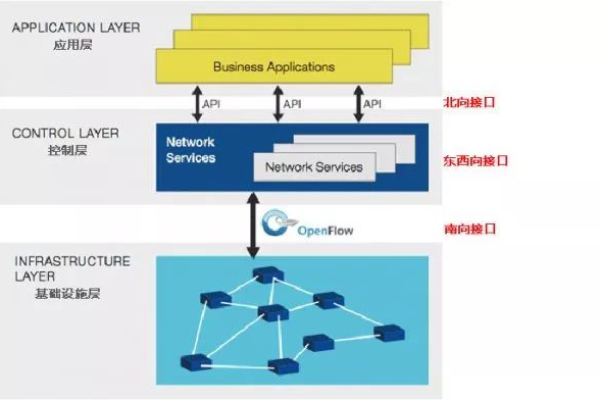

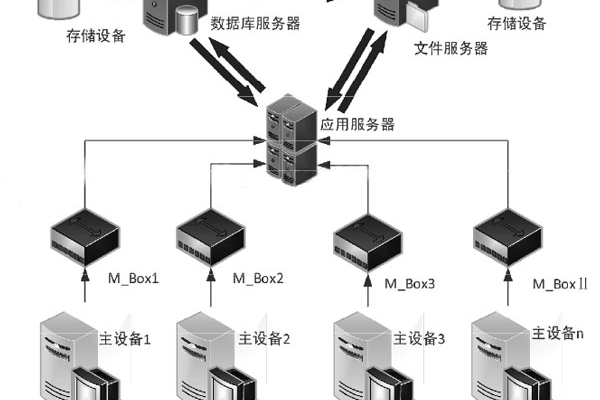

AI服务器操作系统是专为支持人工智能应用而设计的服务器端操作系统,它不仅需要管理传统的计算资源,还需优化以满足AI任务的特殊需求,如高性能计算、大规模并行处理和低延迟等,这类操作系统通常基于Linux发行版进行定制和优化,以提供更好的稳定性、安全性和兼容性。

1、基本要求

| 特性 | 说明 |

| 高性能计算 | 支持多核处理器、GPU加速和高效内存管理 |

| 可扩展性 | 能够轻松扩展计算资源以适应不断增长的AI工作负载 |

| 低延迟 | 优化系统调用和网络协议以减少数据传输延迟 |

| 安全性 | 强化安全机制保护敏感数据和模型免受攻击 |

2、关键技术

| 技术 | 功能 |

| 容器化 | 轻量级虚拟化技术,用于隔离AI应用环境 |

| 自动化运维 | 利用AI技术实现系统的自动监控、故障预测和自我修复 |

| 异构计算支持 | 兼容CPU、GPU、FPGA等多种计算资源 |

| 分布式存储 | 提供高吞吐量的数据访问和冗余备份 |

3、应用场景

| 场景 | 描述 |

| 深度学习训练 | 支持大规模神经网络模型的训练任务 |

| 机器学习推理 | 快速响应AI模型的推理请求 |

| 大数据分析 | 处理海量数据集以提取有价值的信息 |

| 边缘计算 | 在靠近数据源的位置执行AI任务以减少延迟 |

4、主流产品

| 产品名称 | 特点 |

| Ubuntu Server for AI | 开源免费,社区支持强大,易于定制 |

| CentOS Stream for AI | 企业级稳定性,长期支持周期 |

| Red Hat Enterprise Linux for AI | 商业版Linux,提供全面的技术支持和服务 |

| Anolis OS | 由龙蜥社区开发,全面兼容国内外主流CPU、GPU架构 |

三、相关问题与解答

1、问:为什么AI服务器操作系统需要特别关注安全性?

答:AI应用往往涉及敏感数据和关键业务逻辑,因此确保操作系统的安全性至关重要,以防止数据泄露、反面攻击或模型改动。

2、问:如何选择合适的AI服务器操作系统?

答:选择时应考虑系统的兼容性(与硬件和其他软件)、性能(如计算能力和内存管理)、安全性以及社区和支持情况,对于企业用户来说,还需要考虑供应商的支持和服务。