如何选择适合开设魔域私人服务器的服务器类型?

- 行业动态

- 2024-10-06

- 6

开魔域公益服务器选择指南

服务器硬件配置要求

1、处理器(CPU):

至少四核以上,建议六核心或更高,多核心处理器能够提供更好的多任务处理能力,确保游戏服务器在高负载情况下依然稳定运行。

2、内存(RAM):

最低8GB,推荐16GB或更高,足够的内存可以支持更多的玩家同时在线,并保证游戏的流畅运行。

3、存储(硬盘):

至少500GB的硬盘空间,用于存储游戏文件和数据,推荐使用固态硬盘(SSD),以提升数据读写速度和整体性能。

4、带宽:

稳定的高速网络连接,至少100Mbps的带宽,低延迟和高带宽可以确保玩家获得良好的游戏体验,特别是在高峰时段。

服务器软件环境

1、操作系统(OS):

常见的选择包括Windows Server和Linux,Linux系统更为稳定和安全,且资源占用较少,适合长时间运行服务器。

2、数据库:

MySQL是最常用的关系型数据库,安装和配置相对简单,稳定可靠,SQL Server也是一个不错的选择,适用于较大规模的游戏服务器。

3、游戏服务器软件:

需要安装魔域公益的特定服务器端程序,根据所用的版本选择对应的服务器软件,并进行相应配置。

云服务器选择

1、亚马逊AWS(Amazon Web Services):

提供多种不同配置的EC2实例,具有高可用性、灵活的计算能力和低延迟的特点,适合搭建大型游戏服务器。

2、微软Azure:

提供虚拟机和存储服务,可以根据实际需求选择合适的配置,确保游戏服务器的性能和稳定性。

3、腾讯云:

提供高性能的云服务器CVM,专门针对游戏行业的云服务器解决方案,如游戏服务器集群等。

4、阿里云:

提供多种类型和规格的云服务器实例,基于云联网技术的高速网络传输,适合大规模的游戏服务器搭建。

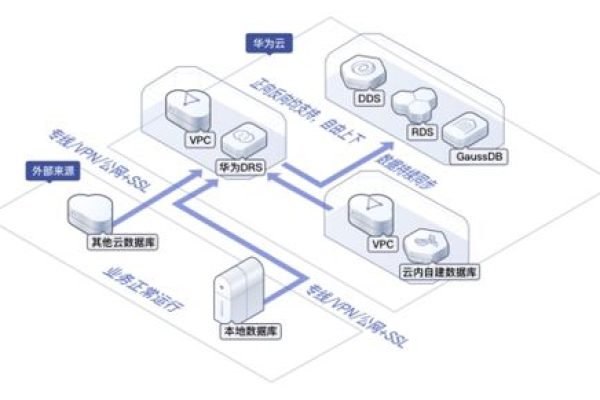

5、华为云:

提供灵活的云服务器实例,云联网和专线接入等服务,可实现高速稳定的网络传输。

其他关键要素

1、IP地址和端口转发:

确保服务器拥有固定的公网IP地址,并通过路由器进行端口转发,将外部连接请求转发到正确的内部IP地址和端口上。

2、配置文件:

根据服务器软件的要求,正确配置游戏参数、数据库连接等信息,确保服务器能够正常连接和使用数据库。

3、网络安全:

安装防火墙和安全软件,保护服务器免受攻击,合理规划网络架构和安全策略,确保游戏服务器的安全性。

4、测试与调试:

在开放服务器之前,进行充分的测试和调试,检查数据库连接、注册和登录功能,以及游戏的正常运行,确保服务器的稳定性和性能。

注意事项

1、合法性:

确保开设公益的行为合法,避免侵犯游戏公司的版权和知识产权,最好的方式是与游戏开发商合作,在其授权下开设公益服务器。

2、技术支持:

如果没有足够的技术知识和经验,建议寻求专业团队的技术支持,以确保服务器的顺利搭建和运营。

通过综合考虑以上因素,您可以选择适合的服务器来开设魔域公益,提供稳定、流畅的游戏体验。

【开魔域公益所需服务器类型及配置建议】

服务器类型

1、游戏服务器:选择专业的游戏服务器,这类服务器通常具备低延迟、高稳定性等特点,适合运行大型游戏如魔域公益。

2、虚拟主机:如果预算有限,可以考虑使用虚拟主机,但需注意选择性能较好的虚拟主机,以确保游戏运行流畅。

服务器配置建议

1、处理器(CPU):建议使用四核或以上CPU,如Intel Core i5、i7或AMD Ryzen 5、7等,以确保服务器处理能力充足。

2、内存(RAM):至少8GB内存,建议16GB以上,以便同时处理大量玩家连接和游戏数据。

3、硬盘(HDD/SSD):建议使用SSD硬盘,读写速度快,可以显著提高游戏运行效率,至少500GB容量,根据游戏数据大小可适当增加。

4、网络带宽:选择高速稳定的网络,至少100Mbps下行带宽,最好有更高的上行带宽,以保证玩家之间的数据传输流畅。

5、操作系统:选择Windows Server或Linux Server,根据个人熟悉程度和服务器管理需求选择。

6、安全防护:安装防火墙、载入检测系统等安全软件,确保服务器安全稳定运行。

其他注意事项

1、数据备份:定期备份服务器数据,以防数据丢失或损坏。

2、稳定供电:确保服务器有稳定的电源供应,避免因断电导致数据丢失或服务器损坏。

3、环境温度:保持服务器运行环境温度适宜,避免过热影响服务器性能。

为开魔域公益所需服务器类型及配置建议,具体配置可根据实际情况和预算进行调整。