distinct性能 distinct与group by优化

- 行业动态

- 2024-06-20

- 14

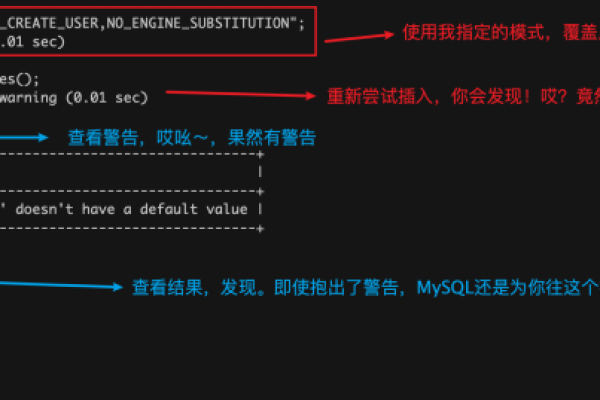

在数据库查询优化中,DISTINCT操作和GROUP BY子句是两种常用的方法来去重或聚合数据,它们在性能方面有各自的优势和劣势,理解它们的工作原理和如何优化它们的使用对于提高数据库查询性能至关重要。

DISTINCT 性能

DISTINCT关键字用于返回唯一不同的值,当你对一个字段使用DISTINCT时,数据库会返回该字段的所有不同值,如果对多个字段使用DISTINCT,则会返回所有字段组合的唯一记录。

性能考虑因素:

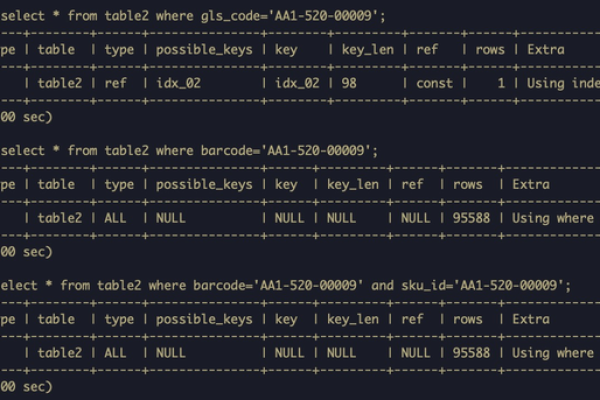

索引:如果查询中的字段被索引,DISTINCT操作通常会更快,因为数据库可以利用索引来快速找出唯一的值。

数据量:数据集的大小直接影响DISTINCT操作的性能,数据量越大,执行时间可能越长。

排序:在某些数据库系统中,DISTINCT可能会隐式地触发排序操作,这会增加额外的开销。

GROUP BY 优化

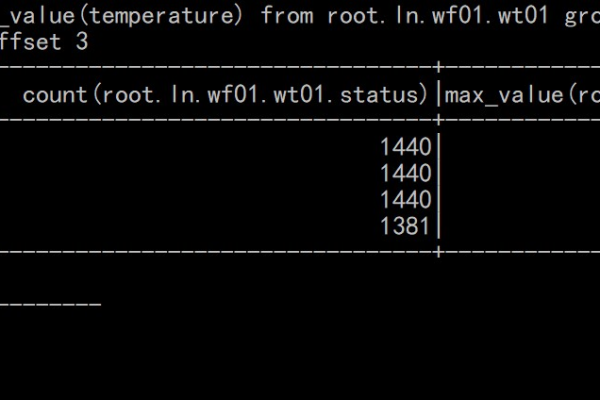

GROUP BY子句用于对结果集进行分组,通常与聚合函数(如COUNT(),SUM(),AVG()等)一起使用,它可以对每个组应用聚合函数,从而得到每个组的统计信息。

性能优化技巧:

索引:为分组字段创建索引可以显著提高GROUP BY操作的性能。

覆盖索引:如果查询所需的所有数据都包含在索引中,数据库可以直接使用索引数据,避免访问表数据,从而提高性能。

分区表:在大型数据集上,使用分区表可以将数据分成更小、更易管理的部分,提高查询性能。

减少分组列:减少GROUP BY子句中的列数可以提高性能,因为这样可以减少分组的数量。

比较 DISTINCT 与 GROUP BY

虽然DISTINCT和GROUP BY都可以用于去重,但它们的用途和性能特点有所不同,如果你只需要去除重复的行,而不需要对数据进行任何聚合计算,使用DISTINCT可能更合适,相反,如果你需要对每个组执行聚合函数,那么GROUP BY是更好的选择。

在性能方面,两者都有潜在的优化空间,但具体的性能表现取决于数据的结构、索引的使用以及查询的具体需求。

相关问答FAQs

Q1: 在什么情况下使用DISTINCT比GROUP BY更好?

A1: 当你只需要从结果集中去除重复的行,而不需要对这些行进行任何聚合计算时,使用DISTINCT是更好的选择,它通常比GROUP BY更简单,因为它不需要指定聚合函数或分组列。

Q2: 如何优化包含GROUP BY的查询?

A2: 优化包含GROUP BY的查询可以采取以下几种方法:

1、为分组列创建索引,以加速分组操作。

2、使用覆盖索引,确保查询所需的所有数据都包含在索引中,从而避免访问表数据。

3、在大型数据集上使用分区表,将数据分成更小的部分,以提高查询性能。

4、减少GROUP BY子句中的列数,以减少分组的数量。

5、考虑使用其他技术,如汇总表或缓存,以减少对原始数据的重复查询。

通过这些方法,你可以显著提高包含GROUP BY的查询的性能。

下面是一个关于_distinct 与GROUP BY 在性能优化方面的简单介绍对比:

| 特性/操作 | _distinct |

GROUP BY |

| 基本用途 | 用于返回唯一不同的值。 | 用于对结果集进行分组,通常结合聚合函数使用。 |

| 性能开销 | 1. 通常在执行时需要创建临时表或唯一索引,从而增加了资源消耗。 | 1. 需要对数据进行排序和分组,可能会增加CPU和内存的使用。 |

| 优化方式 | 1. 使用索引可以显著提高性能。 2. 对于小数据集,使用内存表可以优化性能。 |

1. 选择合适的聚合键,以减少分组数量。 2. 使用索引可以优化查找和排序速度。 3. 对于大数据集,合理使用 HAVING子句替代WHERE子句。 |

| 适用场景 | 1. 当只需要返回唯一的记录时。 2. 数据集相对较小时。 |

1. 需要按某一字段或多个字段进行聚合计算时。 2. 对大量数据进行分组统计时。 |

| 注意事项 | 1. 在大数据集上使用可能导致性能下降。 2. 在不支持索引的数据库或字段上使用,性能较差。 |

1. 不当的GROUP BY可能会导致大量的排序和分组操作,降低性能。2. 应避免在分组字段上使用复杂的表达式。 |

| 可读性 | 通常简单明了,易于理解。 | 可能更复杂,特别是当结合多个聚合函数和复杂的逻辑时。 |

| 灵活性 | 较低,仅返回唯一的行。 | 高,可以结合多种聚合函数和子句,进行复杂的统计和分组。 |

请注意,这个介绍提供的是一般性的信息,不同的数据库管理系统(如MySQL, PostgreSQL, SQL Server等)和具体的数据情况可能会对性能有不同的影响,性能优化通常需要根据具体的数据库设计和查询需求来定制。