美颜人脸识别技术,真的能完美融合美丽与安全吗?

- 行业动态

- 2024-11-24

- 7

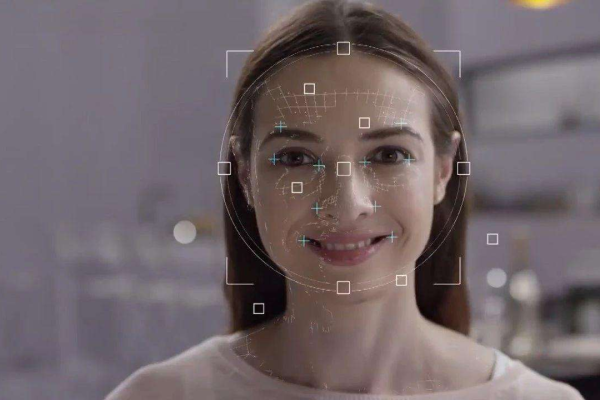

在这个数字化与视觉审美并重的时代,美颜人脸识别技术正悄然改变着我们的日常生活和社交互动方式,这一技术融合了先进的人脸识别算法与图像美化处理技术,不仅能够精准识别人脸特征,还能在保留个人独特面貌的同时,智能优化肌肤质感、调整五官比例、甚至模拟不同的妆容效果,让每个人都能在镜头前展现出最佳状态,我们将深入探讨这一技术的魅力所在,并通过表格形式对比几款主流美颜人脸识别应用的功能特点,最后附上两个常见问题的解答。

美颜人脸识别技术的应用场景

社交媒体:用户在分享照片或视频前,使用美颜功能提升自我形象,增加内容吸引力。

在线会议:部分软件提供实时美颜功能,帮助用户在视频会议中保持专业且自信的形象。

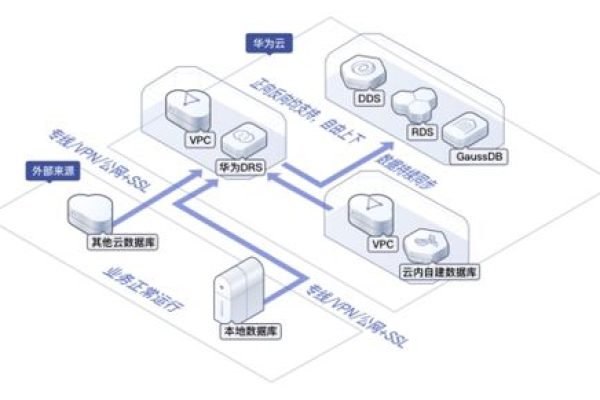

安防监控:结合人脸识别技术,用于门禁系统、公共安全等领域,同时支持美颜处理以保护个人隐私。

娱乐直播:主播通过美颜功能增强观众观看体验,促进粉丝互动。

摄影摄像:无论是专业摄影师还是普通用户,都能利用该技术提升作品美感。

主流美颜人脸识别应用功能对比

| 应用名称 | 实时美颜 | 滤镜种类 | 五官调整 | AI美妆 | 隐私保护 |

| App A | 50+ | 全面部 | 强 | ||

| App B | 30+ | 基础 | 中 | ||

| App C | 20+ | 无 | 弱 |

FAQs

Q1: 使用美颜人脸识别技术是否会泄露我的个人信息?

A1: 正规的美颜人脸识别应用通常会采取严格的数据加密和隐私保护措施,确保用户信息的安全,在选择应用时,建议查看其隐私政策,了解数据收集、使用及存储方式,选择信誉良好的平台,关闭不必要的权限请求也是保护个人隐私的有效方法。

Q2: 美颜处理后的照片是否还能真实反映我的样子?

A2: 美颜处理主要是为了提升视觉效果,可能会在一定程度上改变肤色、平滑肌肤、调整五官等,因此处理后的照片与实际外貌存在差异,虽然高级的美颜算法力求自然逼真,但完全不失真的美颜效果难以实现,重要的是找到平衡点,既能展现个人魅力,又不失真实感,对于正式场合或需要准确反映外观的情况,建议谨慎使用或选择轻度美颜模式。

以上内容就是解答有关“美颜人脸识别_美颜”的详细内容了,我相信这篇文章可以为您解决一些疑惑,有任何问题欢迎留言反馈,谢谢阅读。