分词工具在自然语言处理中的应用与挑战是什么?

- 行业动态

- 2024-08-28

- 3

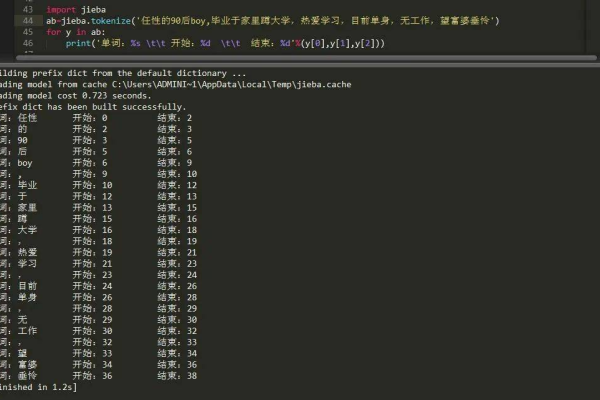

分词工具是一种自然语言处理技术,用于将连续的文本分割成一个个独立的词语。这种工具在中文文本处理中尤为重要,因为中文写作时不像英文会在单词间留有空格。常见的分词工具包括结巴分词、HanLP、THULAC等。

分词工具

分词,是自然语言处理(NLP)中的一项基础技术,它指的是将连续的文本切分成有意义的单元,如单词、短语或符号等,在中文处理中,由于中文书写不像英文那样有空格分隔单词,分词尤其重要和复杂,分词工具就是实现这一过程的软件程序。

分词工具的重要性

提高信息检索效率:搜索引擎利用分词来理解用户的查询意图,返回更准确的结果。

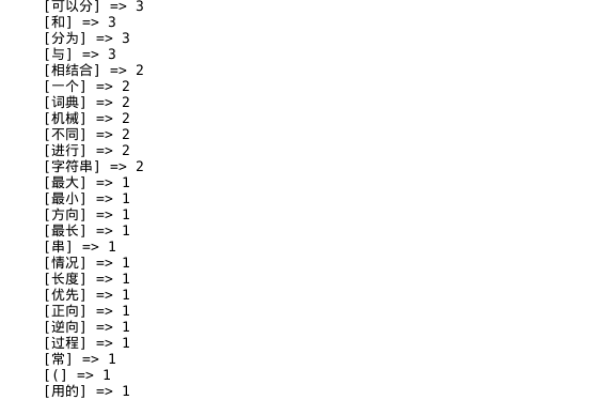

支持文本挖掘:在文本分类、聚类和情感分析等任务中,准确的分词是获取高质量特征的前提。

促进机器翻译:分词有助于机器正确识别源语言中的词汇单位,提升翻译质量。

改善语音识别与合成:语音识别系统依赖准确的分词来提高识别率,而语音合成则需要分词来确定适当的停顿和语调。

分词工具的分类

分词工具可以根据其算法和技术分为以下几类:

1、基于规则的分词器:使用预定义的语言规则来识别词汇边界。

2、基于统计的分词器:通过分析大量文本数据中单词共现的频率来进行分词。

3、基于机器学习的分词器:训练模型识别词汇边界,可以进一步细分为监督学习和无监督学习。

4、混合方法分词器:结合以上几种方法,以期获得更好的分词效果。

分词工具的评估指标

分词工具的性能通常通过以下指标进行评估:

准确率(Precision):切分结果中正确的比例。

召回率(Recall):实际词汇被正确切分出来的比例。

F值(FMeasure):准确率和召回率的调和平均数,用于综合衡量分词性能。

常见分词工具介绍

下面是一些常见的分词工具及其特点:

| 分词工具 | 类型 | 特点 |

| jieba | 基于规则和统计 | 支持三种分词模式,适合中文处理 |

| NLTK | 基于规则 | 包含丰富的英文处理功能 |

| Stanford NLP | 基于机器学习 | 支持多种语言,包括中文 |

| HanLP | 混合方法 | 高效的中文处理能力,提供丰富API |

| SnowNLP | 基于规则和统计 | 轻量级中文处理库,易于使用 |

分词工具的选择标准

选择分词工具时需要考虑以下因素:

语言支持:确保工具支持你的目标语言。

准确性:根据评估指标选择性能最好的工具。

速度:考虑工具的处理速度,尤其是在大规模数据处理时。

易用性:工具是否容易安装和使用。

社区和支持:强大的社区和良好的文档可以帮助解决遇到的问题。

开源与否:开源工具通常更透明,易于定制。

相关问答FAQs

Q1: 分词工具是否可以处理多语言文本?

A1: 是的,有些分词工具如Stanford NLP支持多语言文本处理,但大多数工具专注于单一语言或特定语系,对于多语言文本,可能需要结合使用多个专门的分词工具。

Q2: 如何提高分词工具的准确性?

A2: 提高分词准确性的方法包括:使用大量高质量的标注数据训练模型;定期更新词库以包含新词汇;针对特定领域优化分词算法;以及结合多种分词方法来提高鲁棒性。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:http://www.xixizhuji.com/fuzhu/163540.html