ai智能语音机器人源码

- 行业动态

- 2025-03-16

- 8

AI智能语音机器人源码详解

1、基本:AI智能语音机器人源码是构建智能对话系统的基石,通常基于先进的自然语言处理(NLP)技术、机器学习算法以及可能的深度学习模型,这些源码使机器人能够理解人类语言、进行逻辑推理并作出相应回应。

2、核心功能模块

语音识别(ASR):将用户的语音输入转换为文本,这是语音对话系统的第一步,它使得系统能够“理解”用户所说的内容,ASR系统通常使用深度学习算法,如循环神经网络(RNNs)、卷积神经网络(CNNs)以及变换器(Transformers)模型来识别语音中的单词和短语。

自然语言处理(NLP):用于理解用户的意图,提取关键信息,并生成合适的响应,NLP涉及多种技术,包括分词、词性标注、句法分析、语义分析等,现代NLP系统,特别是基于大型语言模型(LLM)的系统,能够处理复杂的语言模式和上下文关系。

语音合成(TTS):将文本信息转换为语音输出,这是语音对话系统的最后一步,它使得系统能够以听起来自然的声音“说话”,TTS系统使用复杂的算法来模拟人类的发音,包括音素、韵律和语调,现代的TTS系统,如基于深度学习的端到端模型,能够生成非常自然和流畅的语音。

3、搭建步骤

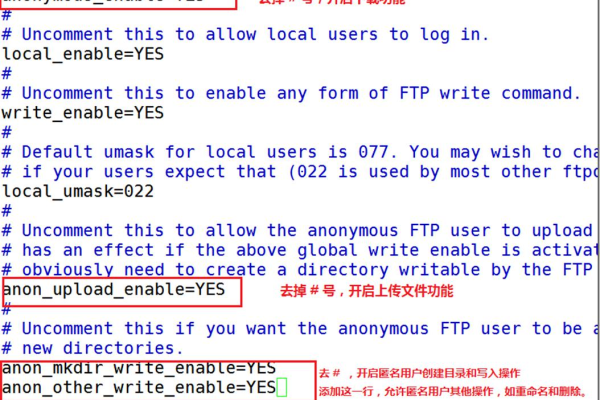

环境准备:选择一台合适的服务器或本地计算机,安装必要的开发工具和库,如Python、TensorFlow或PyTorch(深度学习框架)、Kaldi或CMU Sphinx(开源语音识别库)、Festival或MaryTTS(开源语音合成库)等。

数据收集与处理:收集大量的语音数据和文本数据,用于训练语音识别和自然语言处理模型,数据收集完成后,进行预处理,包括去除噪音、归一化、标注等步骤,以保证数据品质。

模型训练与优化:利用Kaldi或CMU Sphinx库训练声学模型和语言模型;采用TensorFlow或PyTorch框架训练自然语言处理模型;采用Festival或MaryTTS库训练文本到语音的映射模型以及语音合成引擎。

对话管理模块实现:对话管理模块负责整个对话流程,包括使用者意图识别、对话状态追踪、对话策略等,可以采用有限状态机或深度学习模型实现对话管理。

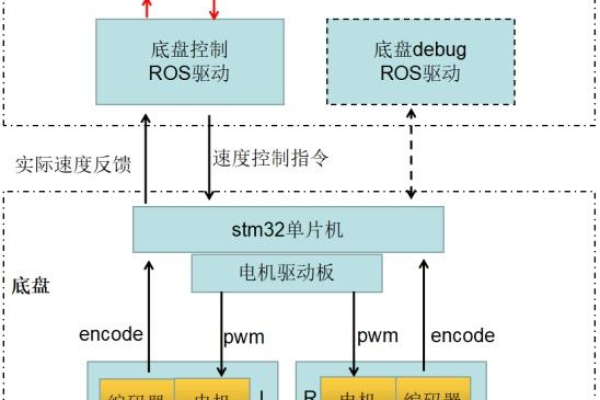

系统整合与测试:将上述四个模块整合到一起构建完整的语音助手系统,并进行功能测试和性能优化,确保系统在实际应用中能够稳定运行。

4、优化建议

注重客户体验:在设计和实现过程中,始终关注使用者需求,增进系统的易用性。

优化算法:不断优化深度神经网络等算法,增强识别准确率和实时性。

丰富语音库:积累丰富的语音数据,为使用者提供多样化的语音输出。

情感交互:通过情感分析等技术,实现与使用者情感的互动,提升客户体验。

相关问题解答

1、什么是AI智能语音机器人的核心优势?

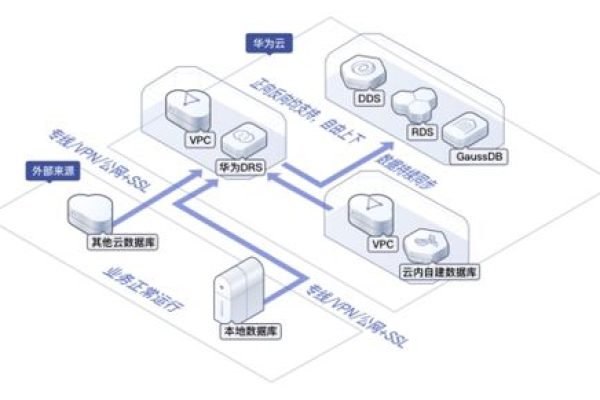

答:AI智能语音机器人的核心优势在于其高度可定制化、持续学习与优化能力、多平台兼容性以及高效的交互方式,企业可根据自身需求调整机器人的对话逻辑、响应方式及功能模块,同时通过机器学习算法不断从用户交互中学习,提升对话的准确性和流畅度,支持跨平台部署,满足不同场景下的应用需求,为企业数字化转型提供有力支持。

2、如何选择合适的AI智能语音机器人源码?

答:在选择AI智能语音机器人源码时,应重点考虑源码的成熟度、社区支持、技术文档完善程度以及是否具备良好的扩展性和可维护性,还需关注源码所依赖的技术栈是否符合项目需求,以及是否有成功的应用案例可供参考,建议优先选择那些经过市场验证、拥有活跃社区和持续更新的源码项目。