如何为农村地区打造高效的网站建设与设备配置?

- 行业动态

- 2024-08-25

- 10

农村网站建设_创建设备

在数字化时代的浪潮中,互联网的普及已经触及到了农村地区,为了促进农业信息化和乡村振兴战略的实施,农村网站的建设变得尤为重要,一个功能完善、内容丰富、操作简便的农村网站可以成为展示农村新面貌、推广农产品、提供农业信息服务的重要平台,本文将介绍农村网站建设所需的基本设备以及创建流程。

1. 网站规划与设计

在开始任何网站建设之前,首先需要进行的是网站规划与设计,这包括确定网站的目标用户群体、内容架构、功能需求、界面风格等,对于农村网站而言,应着重考虑农民的实际需求,如天气预报、种植技术、市场行情等信息的获取。

网站规划要点:

目标明确:服务农村、农民和农业发展。

内容实用:提供对农民有帮助的信息和资源。

操作简便:界面简洁,易于理解和操作。

本地化信息:包含本地新闻、政策解读、农业指导等。

2. 硬件设备选择

主要硬件设备清单:

| 设备名称 | 功能描述 | 备注 |

| 服务器 | 托管网站数据和应用 | 可选择租用云服务器 |

| 网络设备 | 保障网站稳定运行 | 包括路由器、交换机等 |

| 安全设备 | 保护网站不受攻击 | 如防火墙、安全监测系统 |

| 工作站 | 网站开发和维护使用 | |

| 备份设备 | 数据备份与恢复 | 防止数据丢失 |

3. 软件环境搭建

常用软件及服务:

操作系统:如Windows Server、Linux等。

Web服务器:如Apache、Nginx、IIS等。

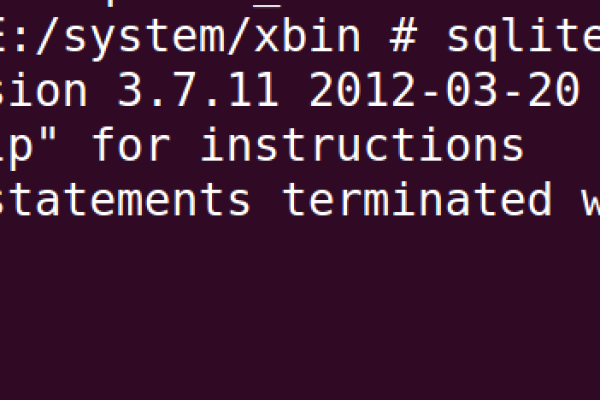

数据库管理系统:如MySQL、PostgreSQL、MongoDB等。

编程语言环境:如PHP、Python、Java等。

网站安全措施:如SSL证书、定期更新和补丁应用。

4. 网站开发与测试

在硬件和软件环境搭建完成后,就可以进入网站开发阶段了,这一阶段通常由专业的网站开发者来完成,包括编写代码、设计界面、实现功能等。

开发步骤:

前端开发:页面布局、样式设计、交互实现。

后端开发:服务器端程序编写、数据库设计、接口实现。

全面测试:功能测试、性能测试、安全测试。

5. 上线与维护

完成开发和测试后,网站就可以正式上线了,上线后的网站需要定期进行内容更新和技术维护,确保网站安全稳定运行。

维护工作包括:

内容更新:定期发布新的信息和资讯。

技术支持:解决用户反馈的问题和技术支持。

安全监控:监控系统安全,及时应对各种安全威胁。

相关问题与解答

Q1: 农村网站是否需要移动适配?

A1: 是的,随着智能手机的普及,越来越多的农民通过手机上网,农村网站应当进行移动适配,确保在手机等移动设备上也能有良好的访问体验。

Q2: 如何保证农村网站的内容质量和更新频率?

A2: 可以建立内容管理团队,负责收集、编辑和发布与农村生活、农业生产相关的内容,也可以鼓励农民自己提交内容,形成互动,为了保证更新频率,可以制定固定的内容更新计划,并严格执行。