如何利用CDN提升视频监控系统的性能与稳定性?

- 行业动态

- 2025-01-06

- 1

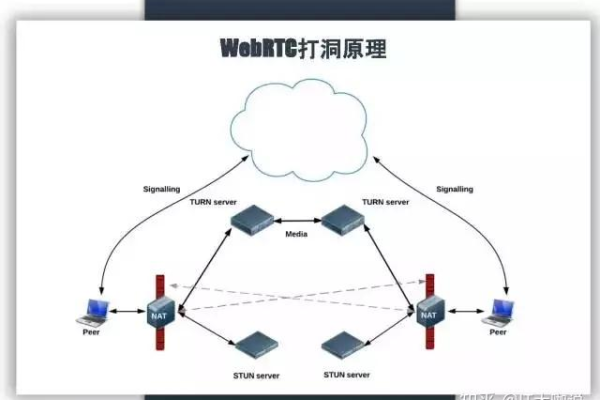

视频监控CDN(内容分发网络)加速技术是一种通过将视频监控内容分发到多个地理位置的服务器上,使用户能够从最近的服务器获取内容的技术,CDN通过减少网络传输延迟和带宽占用,提高了视频流的加载速度和播放质量。

视频监控CDN的基本原理

CDN的基本原理是通过DNS解析和智能调度,将用户的请求导向离用户最近的缓存节点,缓存节点会存储原始服务器上的内容副本,用户请求的内容会从缓存节点直接提供,从而减少了网络传输的距离和时间,提高了访问速度。

CDN的主要功能

1、内容加速:通过将内容缓存到各个节点,提高访问速度。

2、负载均衡:通过智能调度,将流量分散到不同的节点,减轻服务器压力。

3、安全防护:通过防火墙、DDoS防护等技术,提高内容的安全性。

使用CDN加速视频的优势

1、提高访问速度:通过将视频内容缓存到全球各地的节点,CDN可以显著提高视频的访问速度。

2、降低延迟和缓冲时间:CDN通过优化网络传输路径,减少了视频传输过程中的延迟和缓冲时间。

3、提高用户体验:使用CDN可以显著提高用户的观看体验,通过减少视频加载时间和避免卡顿,用户会有更流畅的观看体验。

4、降低服务器负担:CDN将负载分散到多个节点,减轻了源服务器的压力。

如何选择合适的CDN服务提供商

选择合适的CDN服务提供商是确保视频加速效果的重要环节,在选择CDN服务提供商时,需要考虑以下几个方面的因素:

1、覆盖范围:选择CDN服务提供商时,需要考虑其全球覆盖范围,确保服务提供商在目标市场有足够的节点分布,能够提供快速的内容分发服务。

2、服务质量和稳定性:服务质量和稳定性是选择CDN服务提供商的重要因素,需要了解服务提供商的网络性能、稳定性和可靠性,确保能够提供高质量的服务。

3、技术支持和服务保障:选择CDN服务提供商时,还需要考虑其技术支持和服务保障能力,确保服务提供商能够提供及时的技术支持和服务保障,解决使用过程中遇到的问题。

实施CDN加速视频的步骤

实施CDN加速视频需要以下几个步骤:

1、选择合适的CDN服务提供商:需要选择合适的CDN服务提供商,根据目标市场的需求,选择覆盖范围广、服务质量高、技术支持强的服务提供商。

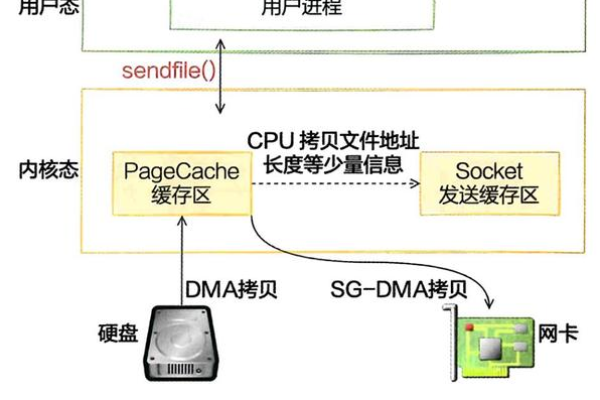

2、配置CDN节点:选择合适的CDN服务提供商后,需要配置CDN节点,配置CDN节点时,需要根据视频内容的分发需求,选择合适的节点分布和缓存策略,确保内容能够快速分发到用户。

3、上传视频内容:配置CDN节点后,需要将视频内容上传到CDN节点,上传视频内容时,可以选择将内容上传到原始服务器,由CDN节点自动同步,也可以选择直接将内容上传到CDN节点。

4、监控和优化:实施CDN加速视频后,需要对CDN节点的性能进行监控和优化,通过监控CDN节点的访问速度、延迟、缓存命中率等指标,及时发现和解决问题,优化CDN加速效果。

常见问题及解决方案

1、缓存命中率低:缓存命中率低是指用户请求的内容未能从缓存节点直接获取,需要从原始服务器获取,解决缓存命中率低的问题,可以通过优化缓存策略、增加缓存节点等方式,提高缓存命中率。

2、视频加载慢:视频加载慢可能是由于网络传输路径不优化、CDN节点覆盖范围不足等原因导致,解决视频加载慢的问题,可以通过优化网络传输路径、增加CDN节点覆盖范围等方式,提高视频加载速度。

3、视频卡顿:视频卡顿可能是由于CDN节点性能不足、网络传输延迟等原因导致,解决视频卡顿的问题,可以通过增加CDN节点性能、优化网络传输路径等方式,提高视频流畅度。

小编有话说

随着互联网技术的发展,视频监控已经成为现代安防系统的重要组成部分,视频监控数据的传输和存储面临着巨大的挑战,CDN技术作为一种有效的解决方案,通过优化网络传输路径和缓存策略,显著提高了视频监控数据的传输效率和用户体验,选择合适的CDN服务提供商并合理配置CDN节点,可以最大限度地发挥CDN技术的优势,为用户提供更加稳定、高效的视频监控服务,随着5G网络和超高清视频技术的普及,CDN技术将在视频监控领域发挥更加重要的作用。

本站发布或转载的文章及图片均来自网络,其原创性以及文中表达的观点和判断不代表本站,有问题联系侵删!

本文链接:http://www.xixizhuji.com/fuzhu/139177.html