ai基础教程

- 行业动态

- 2025-03-16

- 9

AI基础教程

一、人工智能

(一)定义

人工智能(Artificial Intelligence,简称AI)是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学,它旨在使机器能够执行通常需要人类智能才能完成的任务,如学习、推理、解决问题、理解语言等。

(二)发展历程

| 发展阶段 | 时间范围 | 主要特点 |

| 诞生阶段 | 1956年 | 达特茅斯会议标志着人工智能的诞生,提出了“人工智能”这一术语,并开始探索机器能否模拟人类智能的问题。 |

| 发展阶段 | 20世纪60 70年代 | 出现了一些早期的人工智能程序和应用,如专家系统、自然语言处理等,但受限于计算能力和数据不足,发展速度较慢。 |

| 低谷阶段 | 20世纪80 90年代 | 由于对人工智能的预期过高,而实际成果未达到预期,加上计算资源有限等原因,人工智能进入低谷期。 |

| 复兴阶段 | 21世纪初至今 | 随着大数据、云计算、深度学习等技术的发展,人工智能迎来了新的发展机遇,在图像识别、语音识别、自然语言处理等领域取得了显著进展。 |

二、机器学习基础

(一)概念

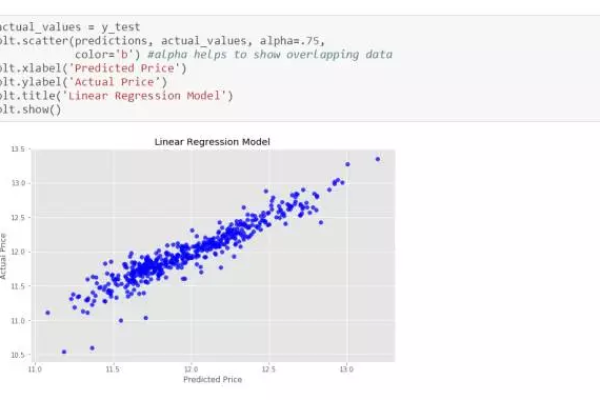

机器学习是实现人工智能的一个重要途径,它是让计算机利用数据而不是指令来改善自身性能的技术,就是让机器从数据中学习规律和模式,从而能够对新的数据进行预测或决策。

(二)常见类型

| 类型 | 特点 | 应用场景 |

| 监督学习 | 通过已标注的训练数据进行学习,建立输入与输出之间的映射关系,根据房屋的面积、房间数量等特征预测房价。 | 图像分类、股票价格预测等。 |

| 无监督学习 | 不依赖于带标签的数据,通过对大量无标签数据的分析和聚类,发现数据中的潜在结构和模式,对客户群体进行细分。 | 数据挖掘、异常检测等。 |

| 强化学习 | 智能体通过与环境的交互,根据环境反馈的奖励信号来调整自己的行为策略,以达到最大化长期奖励的目标,训练机器人在复杂环境中自主导航。 | 游戏智能、机器人控制等。 |

三、深度学习入门

(一)基本概念

深度学习是机器学习的一个分支,它以人工神经网络为基础,通过构建多层神经网络模型来自动学习数据的特征表示,与传统机器学习算法相比,深度学习能够处理更复杂的数据,具有更强的特征提取和表达能力。

(二)常用模型

| 模型名称 | 结构特点 | 适用场景 |

| 卷积神经网络(CNN) | 由卷积层、池化层和全连接层组成,主要用于处理图像等具有网格结构的数据,能够有效提取图像的空间特征。 | 图像识别、目标检测等。 |

| 循环神经网络(RNN)及其变体(如LSTM、GRU) | 能够处理序列数据,通过循环连接神经元,使得信息可以在网络中传递和保存,适用于文本、语音等具有时序特性的数据。 | 机器翻译、情感分析等。 |

四、相关工具与框架

(一)Python编程语言

Python是人工智能领域最常用的编程语言之一,它具有简洁易读、丰富的库和工具支持等优点,许多人工智能算法和框架都有Python接口,方便开发者使用。

(二)深度学习框架

| 框架名称 | 特点 |

| TensorFlow | 由谷歌开发和维护,具有强大的可扩展性和灵活性,支持多平台运行,广泛应用于各种深度学习任务。 |

| PyTorch | 由Facebook开发,以其动态计算图和易于调试的特点受到欢迎,尤其在学术研究领域应用广泛。 |

五、相关问题与解答

(一)问题1:人工智能和机器学习有什么关系?

解答:人工智能是一个广泛的领域,涵盖了多个子领域和技术方向,旨在使机器具备智能,而机器学习是实现人工智能的一种重要方法和技术手段,它通过让机器从数据中学习来改善自身的性能,从而实现某些智能任务,可以说,机器学习是人工智能的重要组成部分,但人工智能不仅仅包括机器学习,还包括其他如专家系统、自然语言处理等技术。

(二)问题2:深度学习为什么能取得成功?

解答:深度学习取得成功的原因主要有以下几点:

强大的特征学习能力:深度学习模型能够自动从大量数据中学习到复杂且有用的特征表示,这些特征往往比手动设计的特征更具代表性和区分性,能够更好地捕捉数据的本质规律。

大数据的支持:随着互联网的发展,产生了海量的数据,为深度学习提供了充足的训练素材,大量的数据可以帮助模型更好地学习和泛化,提高其性能和准确性。

计算能力的提升:现代硬件技术的不断进步,特别是图形处理单元(GPU)的出现和发展,极大地提高了计算速度和效率,使得训练大规模的深度学习模型成为可能。